报告派研读:2025年人工智能行业深度报告

摘要: 人工智能正在深刻重塑战略远见(Strategic Foresight)的实践方式,这一趋势在政府、企业、学术界和民间社会中迅速扩展。根据经济合作与发展组织(OECD)与世界经济论坛联合发布的《人工智能在战略远见中的作用:重 ...

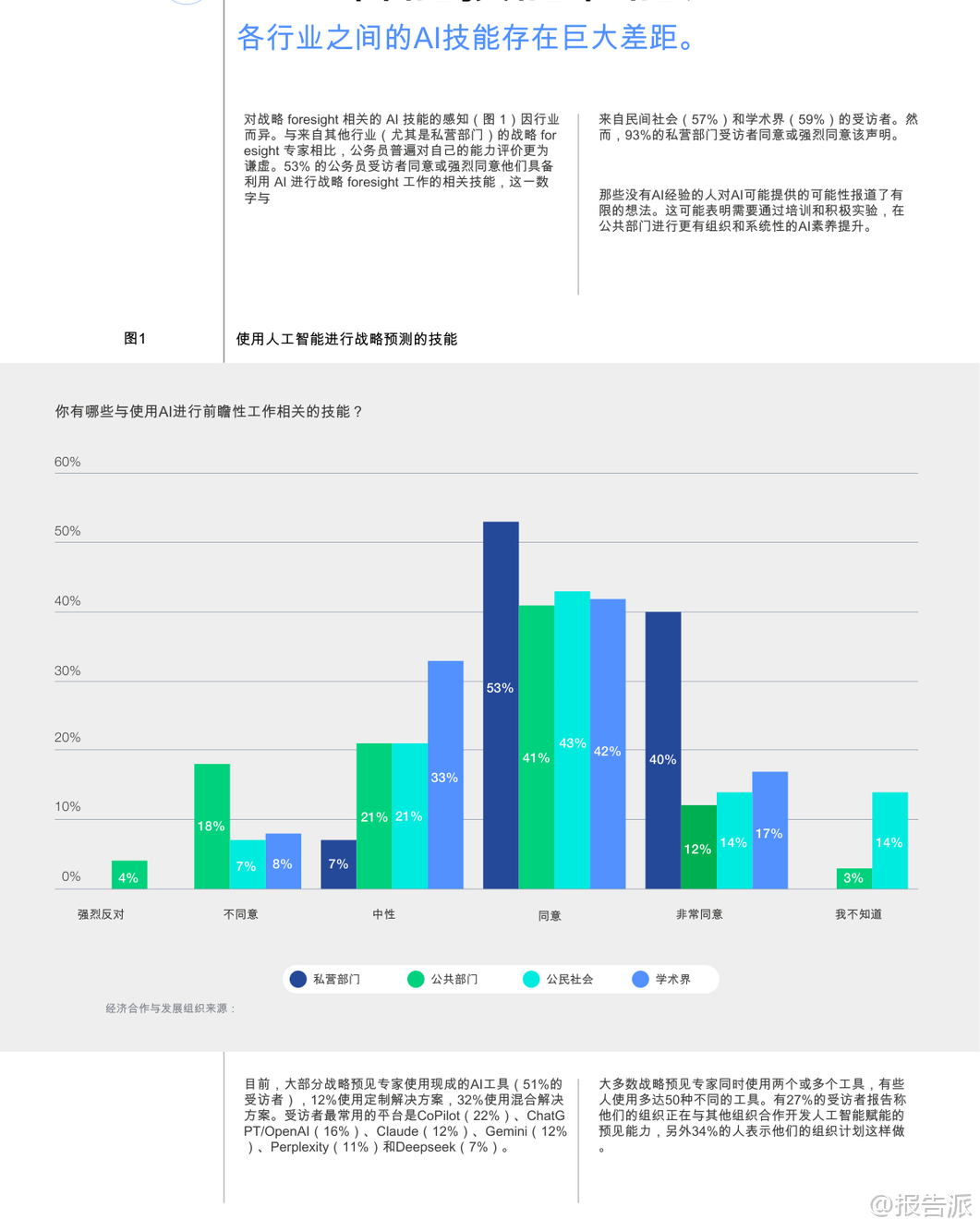

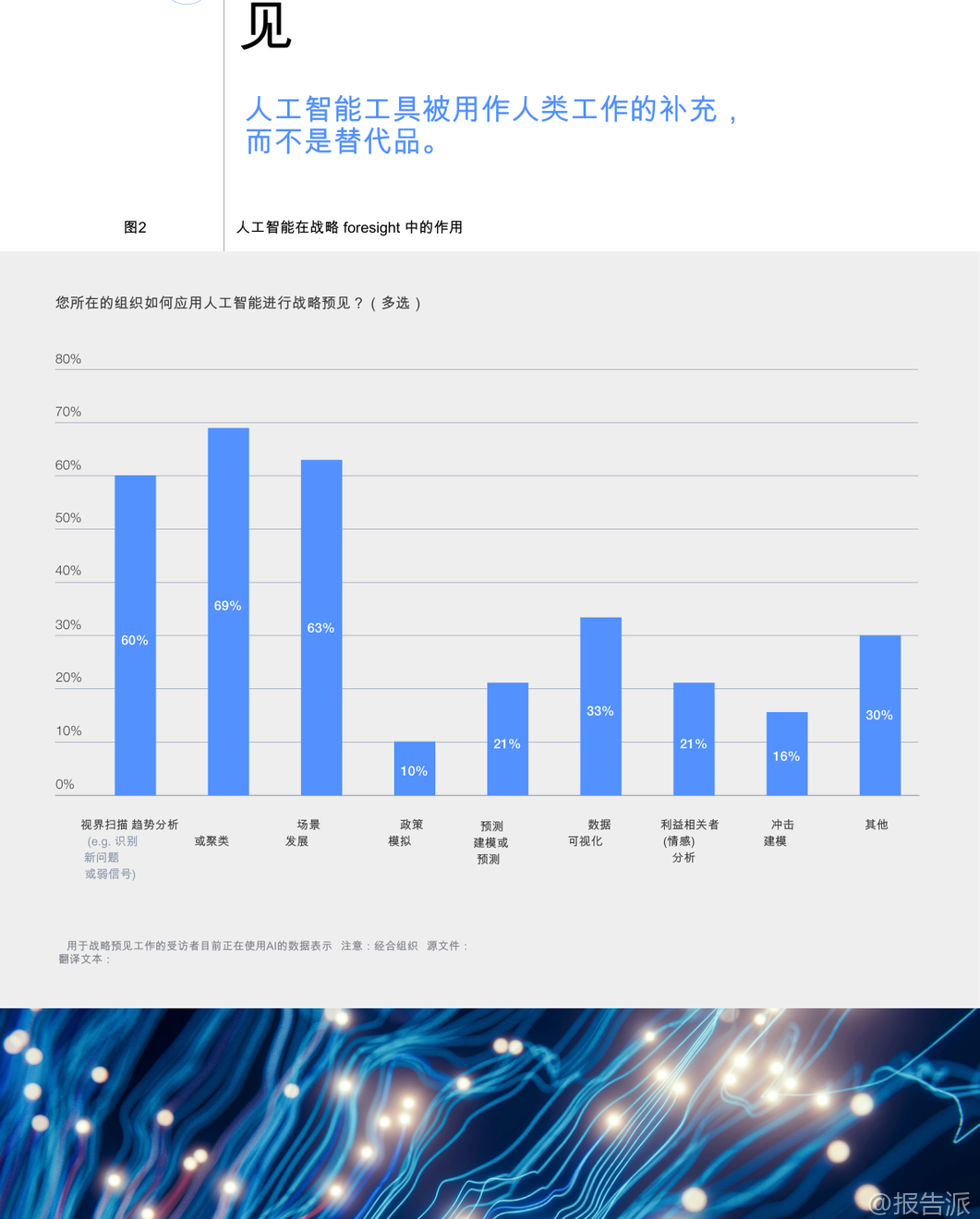

| 人工智能正在深刻重塑战略远见(Strategic Foresight)的实践方式,这一趋势在政府、企业、学术界和民间社会中迅速扩展。 根据经济合作与发展组织(OECD)与世界经济论坛联合发布的《人工智能在战略远见中的作用:重塑预见性治理》白皮书,通过对来自55个国家的167位战略远见专家进行调查,揭示了AI在该领域的应用现状、潜力与挑战。 当前,三分之二的战略远见从业者已在工作中使用人工智能技术。 AI主要被用于趋势分析与聚类(69%)、情景开发(63%)以及远景扫描(60%),显著提升了研究效率和数据处理能力。 大多数实践者将AI视为辅助工具而非替代品,其核心价值在于自动化重复性任务、加速信息整合,并释放专家精力以专注于更高层次的分析、批判性思维与创造性判断。 然而,不同行业之间存在显著的能力差距。 私营部门对AI技能的信心最高,93%的受访者认为自己具备相关能力;而公共部门仅有53%表示认同,民间社会和学术界分别为57%和59%。 这种差距反映出公共部门在AI素养、资源投入和实验文化方面的滞后,亟需通过系统性培训和试点项目加以弥补。 从应用层级来看,AI在战略远见中的融入可分为三个阶段:第一级是“分析增强”,即利用现成AI工具(如Copilot、ChatGPT、Claude、Gemini等)进行初步信息收集与综合;第二级是“创意伙伴”,AI作为陪练角色参与想法生成、信号风洞测试和场景推演,提升创新广度与效率;第三级则是“流程集成”,少数领先机构已开始定制化开发AI平台,将其深度嵌入整个远见流程,实现自动信号检测、趋势建模、情景模拟乃至输出可视化。 尽管AI带来显著效率提升——据受访者反馈可提速10%-15%——但其局限性同样突出。 最常被提及的问题包括输出质量不可靠、容易产生“幻觉”(即虚构事实)、缺乏透明度与可验证性、存在语言与文化偏见(尤其依赖英语和西方历史数据),以及难以进行真正的归纳推理或识别低概率高影响的颠覆性信号。 此外,AI基于已有知识生成内容,难以真正“预见未来”,这使得人类专家在识别未知风险、构建原创性情景方面的作用愈发关键。 伦理与治理短板也成为制约AI广泛应用的重要障碍。 仅27%使用AI的组织制定了正式的伦理指南,多数机构面临数据安全、隐私保护、所有权归属和引用规范不明确等问题。 特别是在公共部门,敏感信息无法随意输入外部AI模型,进一步限制了其应用空间。 同时,来自领导层或利益相关者的阻力在非营利和学术领域更为普遍,反映出组织惯性和对新技术的审慎态度。 值得注意的是,使用经验显著影响人们对AI价值的认知。 有AI实践经验的专家中,43%认为其“必要或高度有用”,47%认为“适度有用”;而在未使用者中,这两个比例分别仅为16%和33%。 这表明“尝试—体验—信任”的路径对于推动AI采纳至关重要。 展望未来,约四分之一的受访者认为AI可能对战略远见实践构成中等到高风险,主要担忧集中在过度依赖导致人类技能退化、低质量输出损害行业公信力,以及算法偏见扭曲决策判断。 但也有多数人持乐观态度,认为AI将增强远见工作的可及性、速度与广度,助力更多组织应对复杂不确定性。 为此,报告提出多项建议:一是全面提升战略远见团队的AI素养,尤其是在公共部门加强培训与实验支持;二是鼓励超越简单应用场景,探索AI作为创意协作伙伴的潜力;三是构建以人为本的工作流程,让AI承担“重体力活”,人类专注高阶认知工作;四是建立清晰的伦理框架与治理机制,确保AI使用的可信度与责任边界;五是通过小规模试点展示价值,克服组织内部的惯性与阻力。 综上所述,AI正成为战略远见领域的催化剂,既带来效率革命,也引发能力重构。 真正的挑战不在于技术本身,而在于如何平衡自动化与人类智慧、速度与深度、普及化与专业化。 唯有将AI视为增强而非取代人类判断的工具,并辅以健全的治理与持续的学习文化,才能实现更具韧性、适应性和前瞻性的政策与决策体系。 本文由【报告派】研读,输出观点仅作为行业分析! 原文标题:2025-11-26-OECD-人工智能行业在战略前瞻中的应用:重塑前瞻治理(英译中) 发布时间:2025年 出品方:OECD

精品报告来源:报告派 |

推荐文章

2

2025年云计算行业应用场景报告

资讯

93人已阅读

3

2025年文科生AI编程研究报告

资讯

97人已阅读

4

2025年人工智能与进攻性安全研究报告

资讯

96人已阅读

5

2025年数据库行业技术趋势报告

资讯

92人已阅读

6

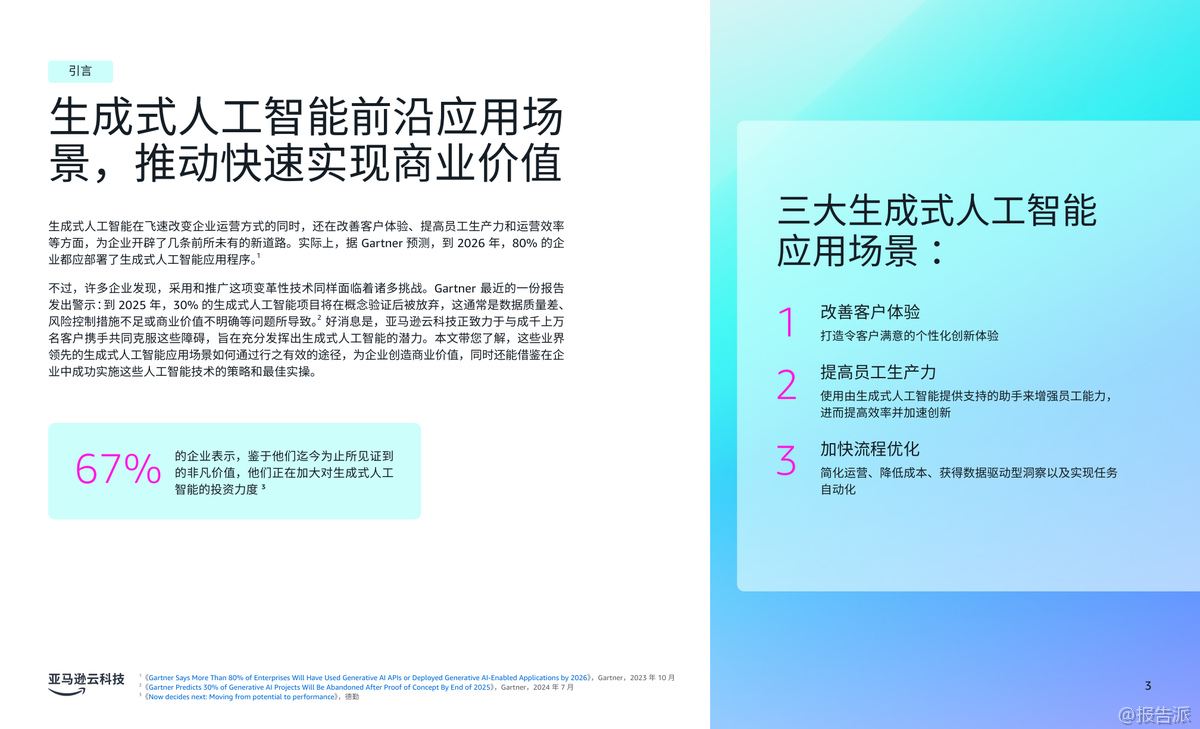

2025年生成式人工智能商业价值报告

资讯

93人已阅读

7

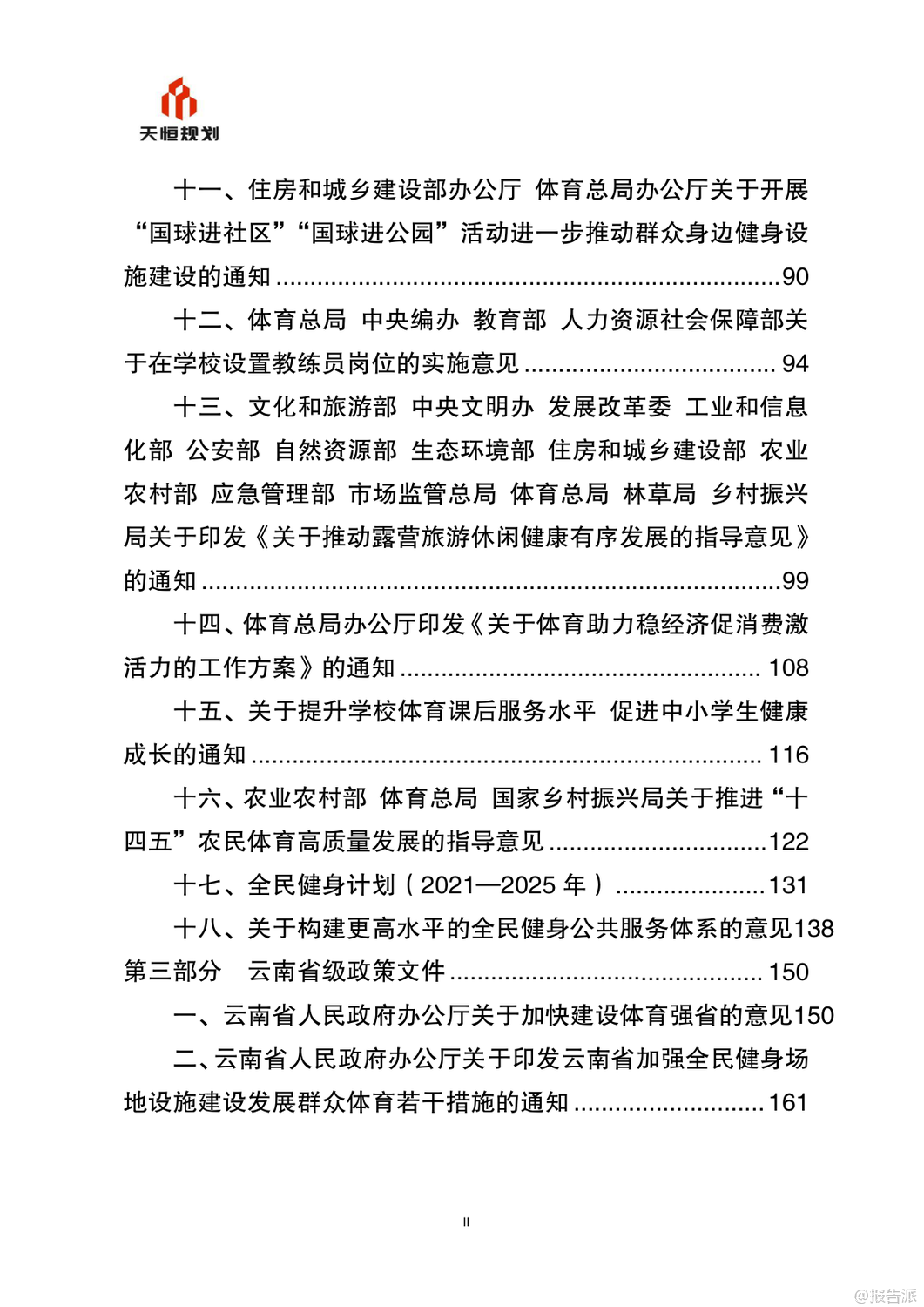

2025年体育领域政策汇编报告

资讯

88人已阅读

8

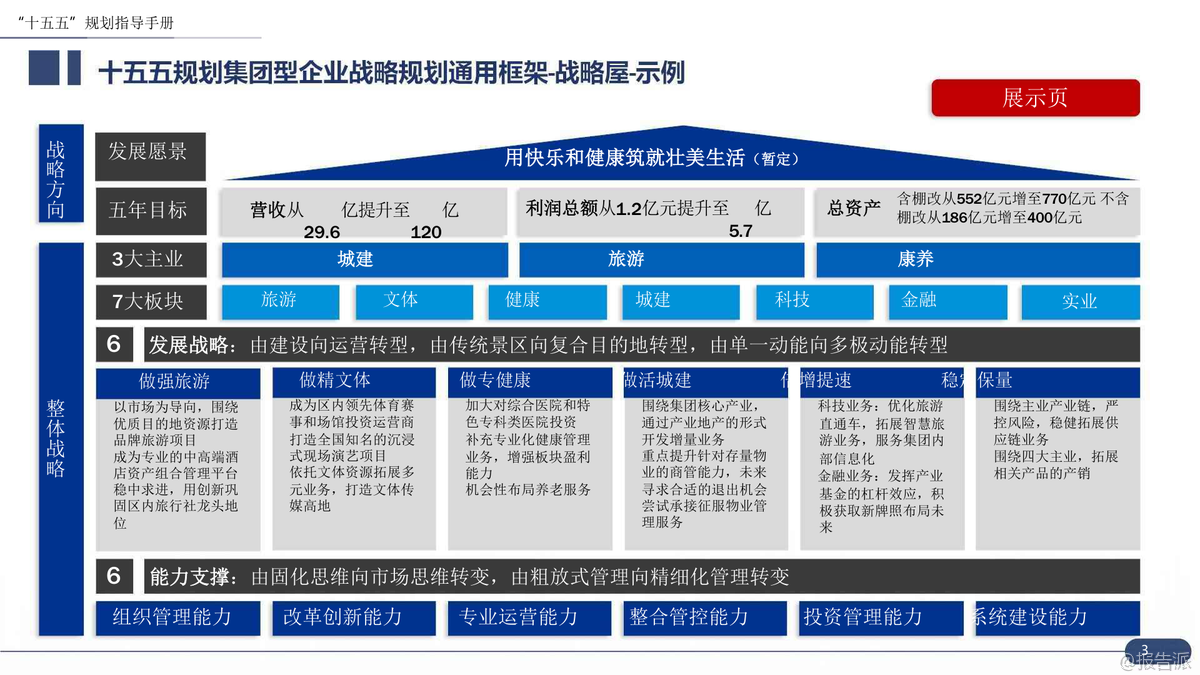

2025年大型央国企“十五五”战略规划编制实

资讯

115人已阅读

9

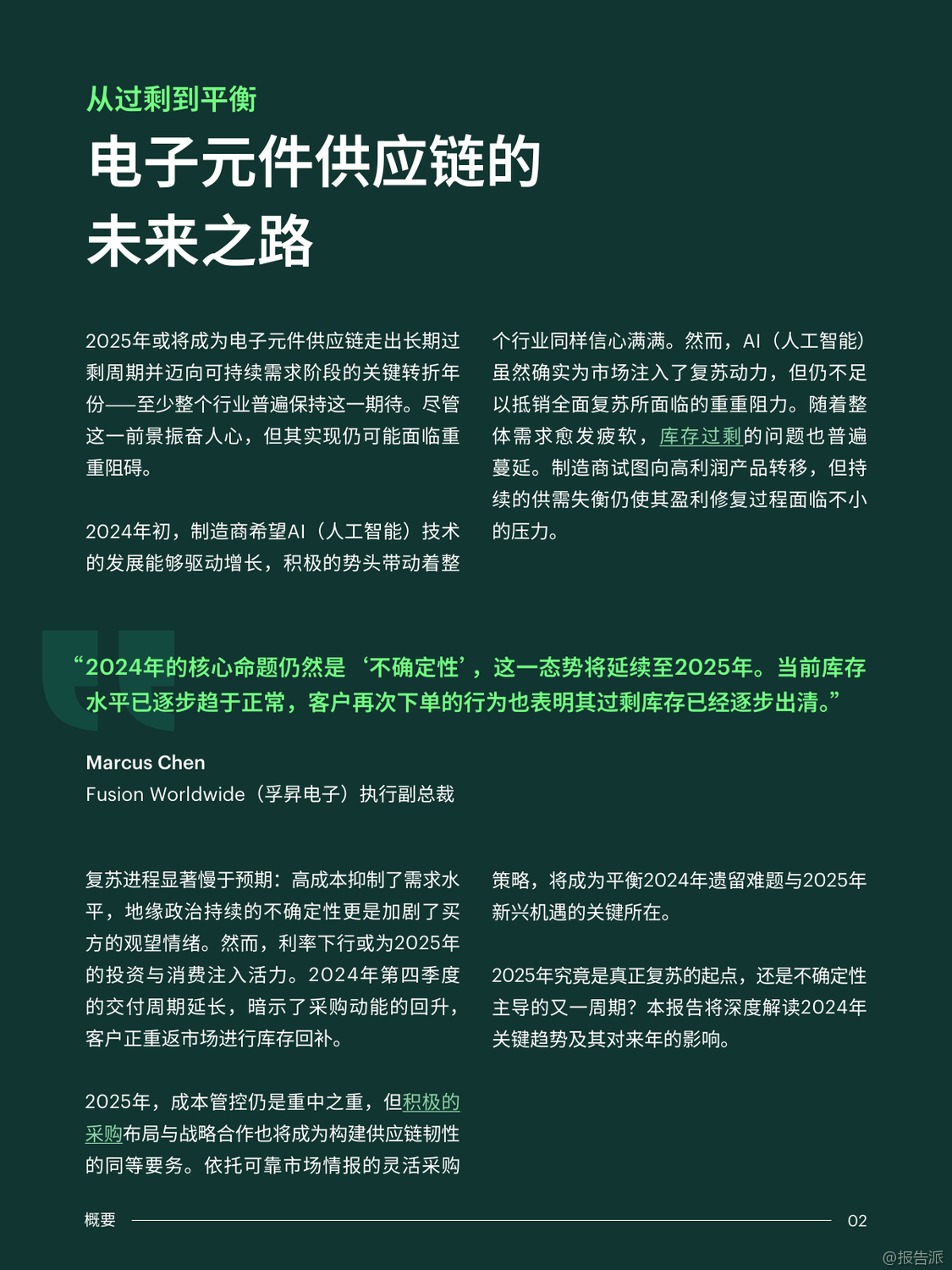

2025年电子元件供应链研究报告

资讯

109人已阅读

10

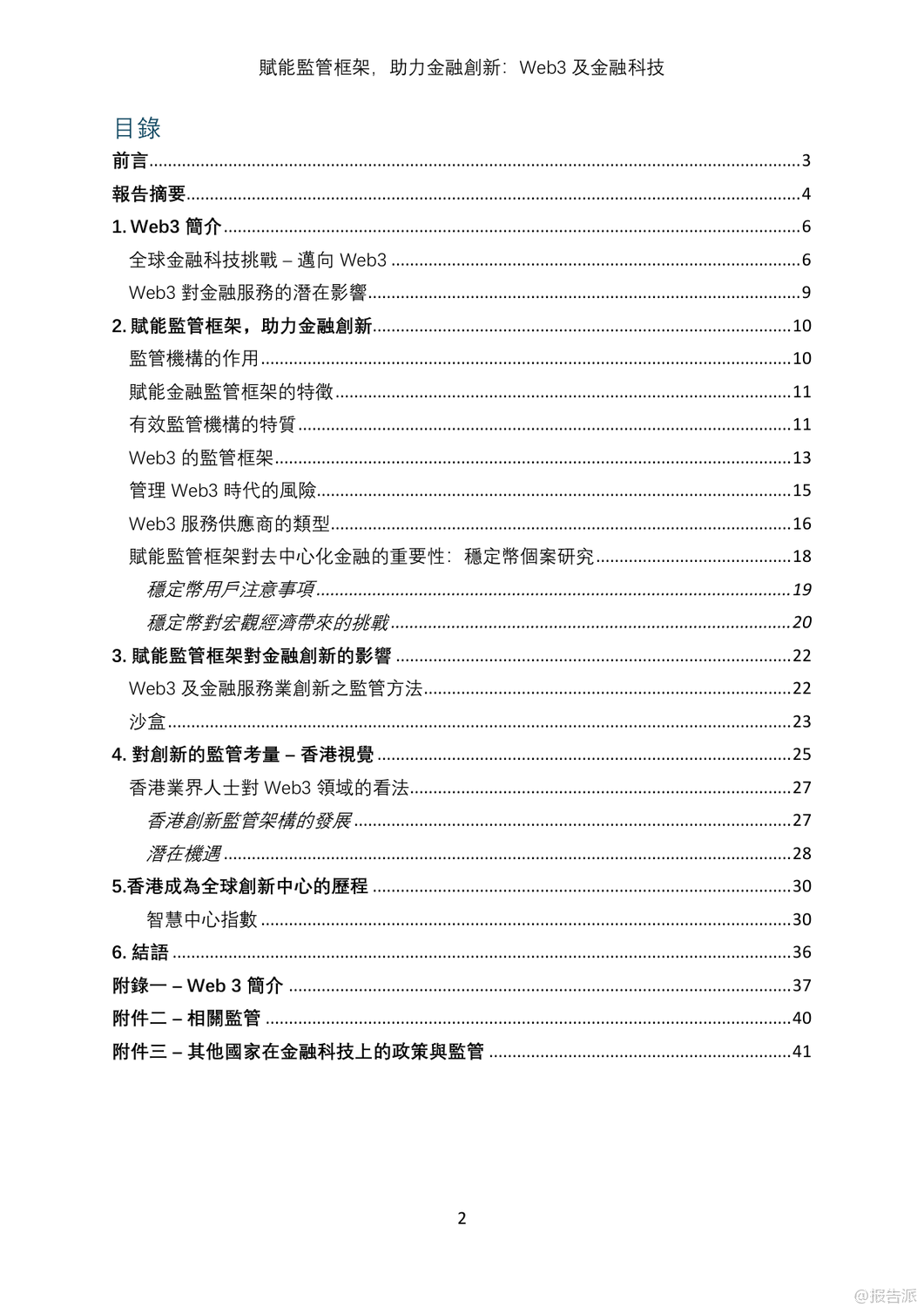

2024年Web3及金融科技研究报告

资讯

85人已阅读

数据图表

2

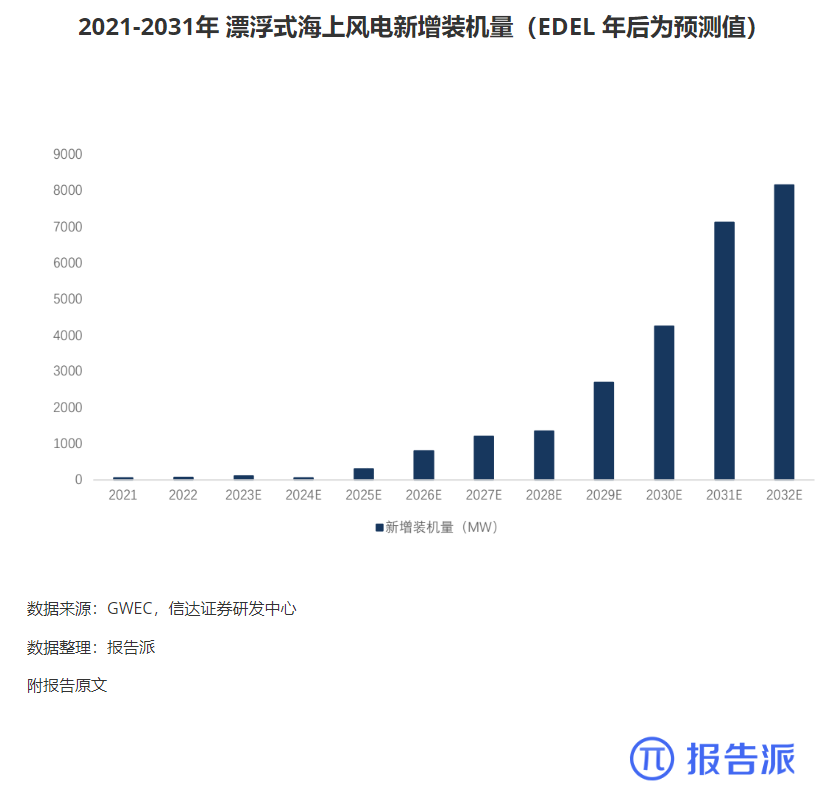

2011-2031 年全球海上风电装机量(含预测)

行业数据

1721人已阅读

3

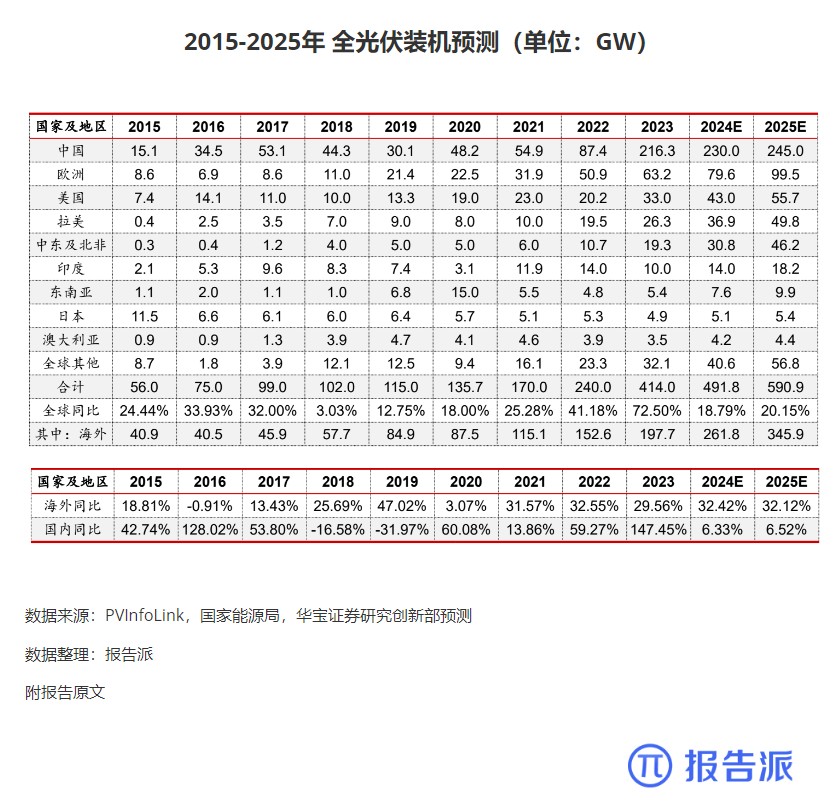

2015-2025年 全光伏装机预测(单位:GW)

市场规模

1955人已阅读

4

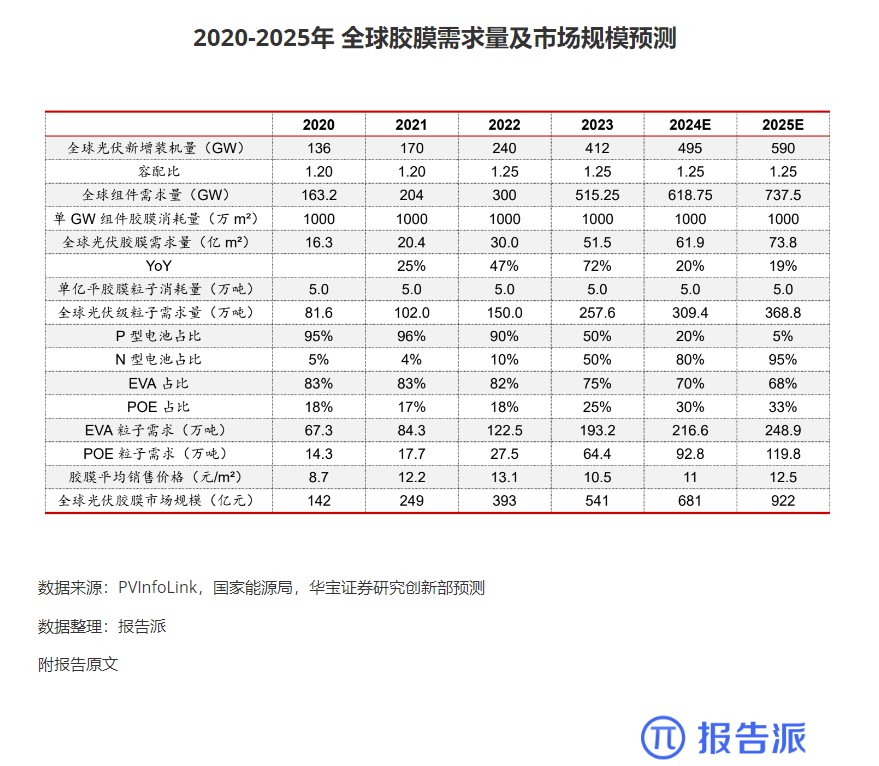

2020-2025年 全球胶膜需求量及市场规模预测

市场规模

1870人已阅读

5

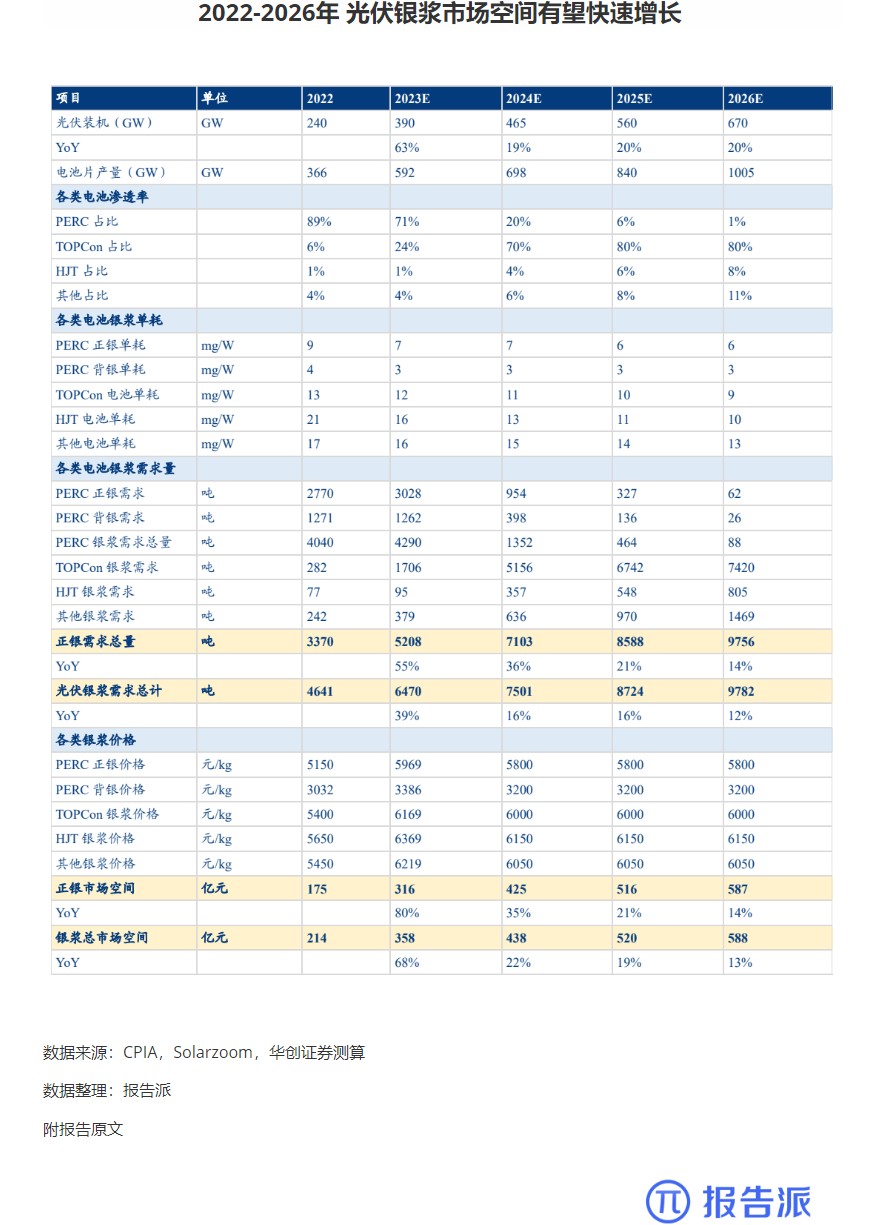

2022-2026年 光伏银浆市场空间有望快速增长

市场规模

1940人已阅读

6

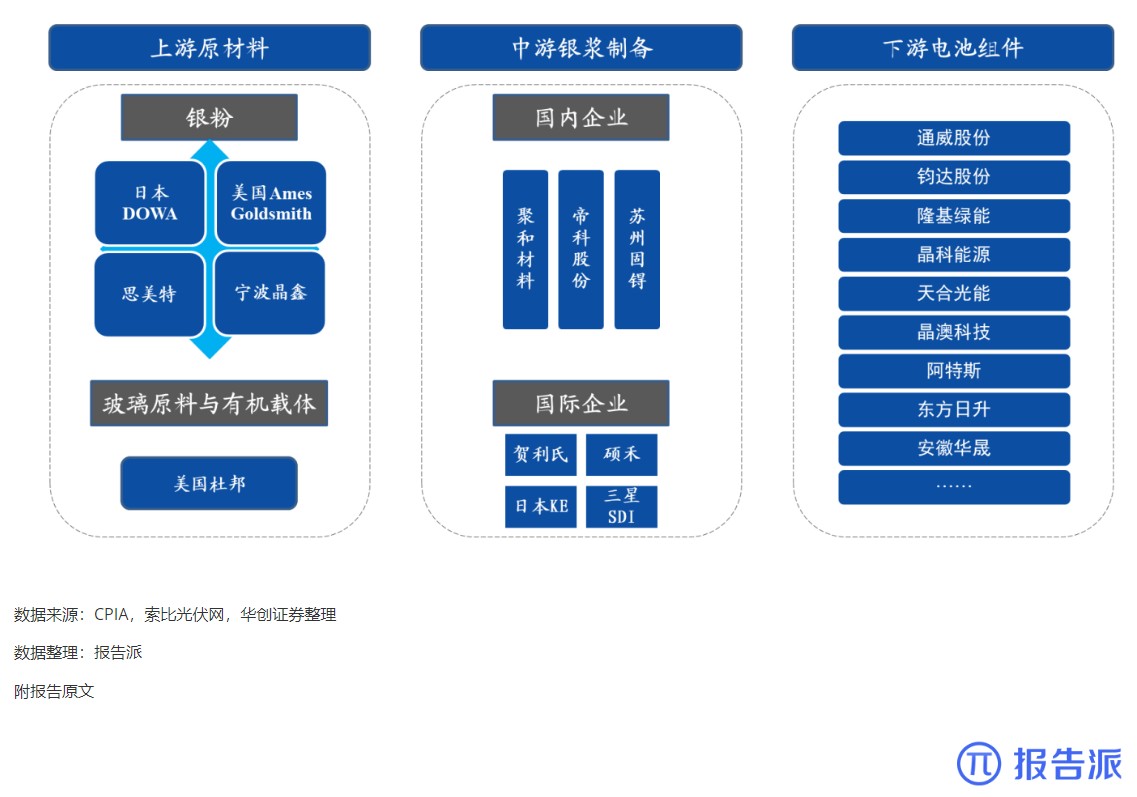

光伏银浆产业链相对简单

技术工艺

1835人已阅读

7

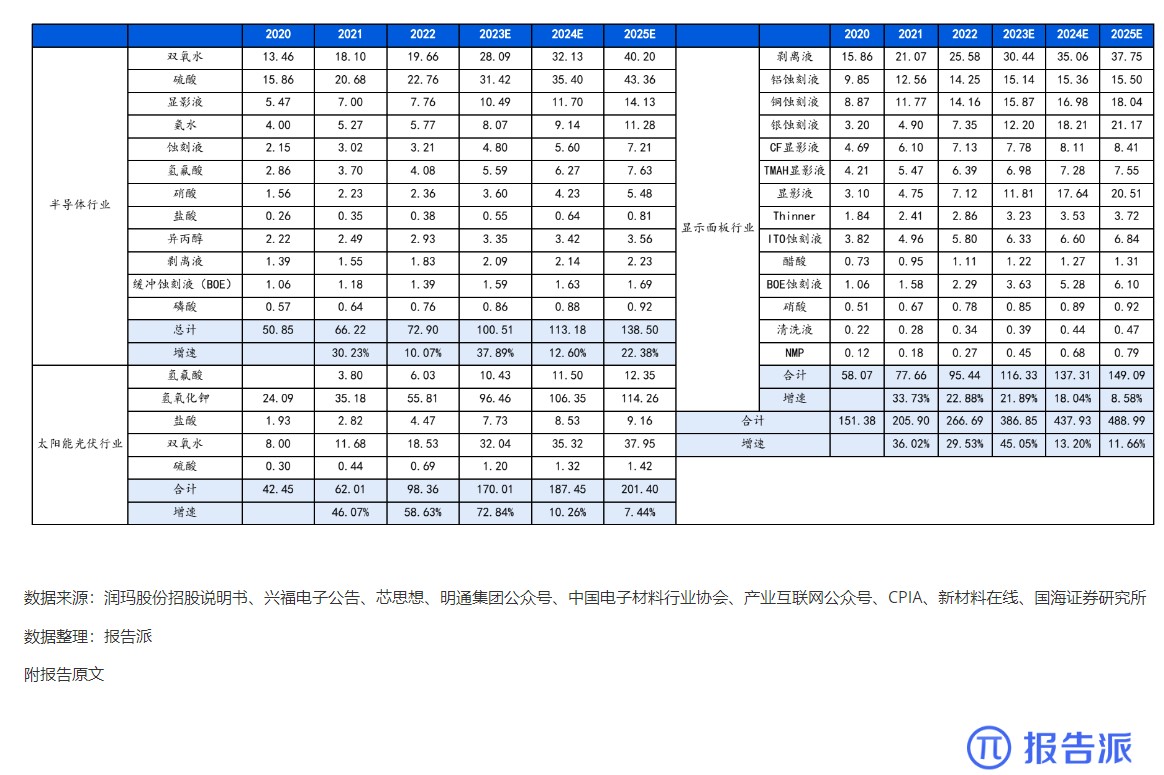

2020-2025年 我国湿电子化学品需求预测(万

市场规模

1816人已阅读

8

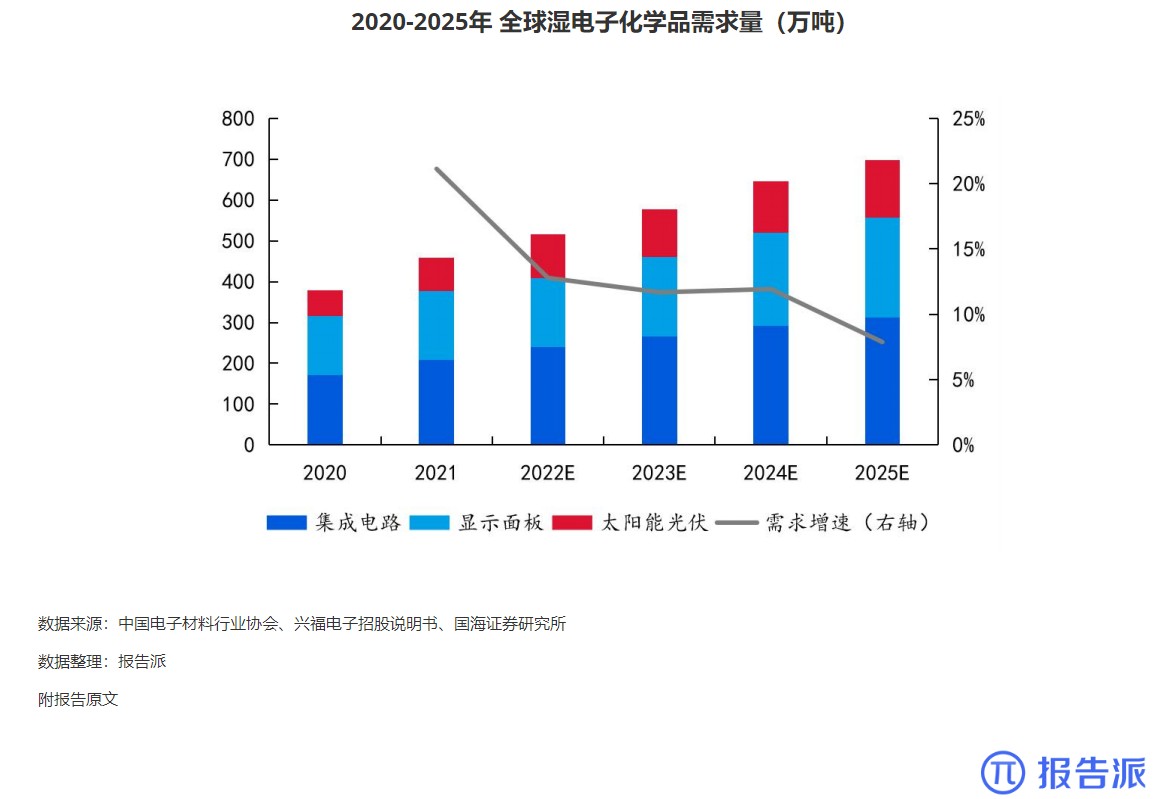

2020-2025年 全球湿电子化学品需求量(万吨

市场规模

1940人已阅读

9

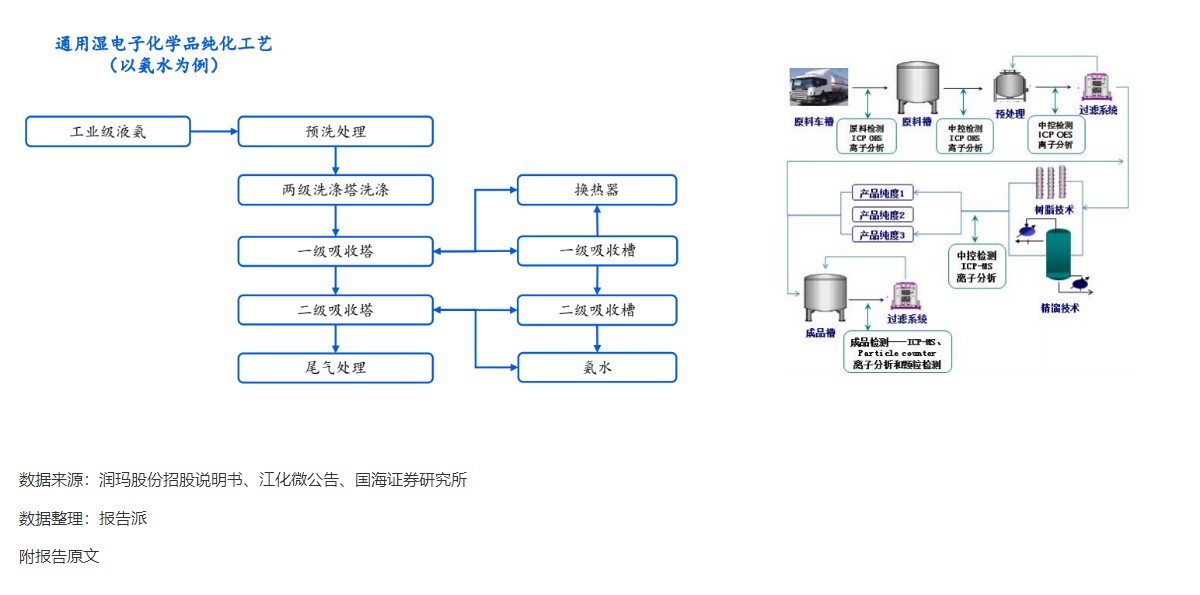

通用湿电子化学品纯化工艺

技术工艺

1680人已阅读

10

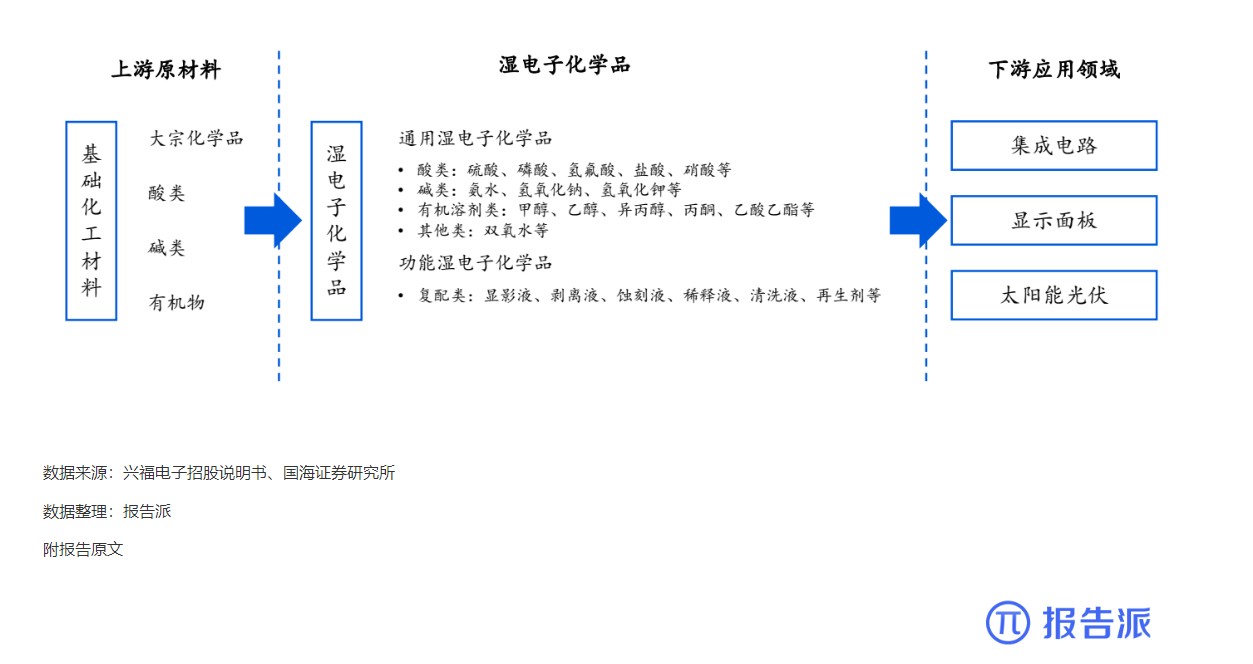

湿电子化学品上下游产业链基本情况

技术工艺

1948人已阅读

热门数据

1

2024年1—2月份规模以上工业增加值增长7.0%

2024-03-22

2

截至2023年底我国累计建成充电基础设施859.

2024-03-22

3

2024年3月21日人民币 NDF 远期合约汇兑美元

2024-03-21

4

2024年1—2月份能源生产情况

2024-03-21

5

2024年2月银行结售汇和银行代客涉外收付款

2024-03-21

6

2024年3月韩国方便面出口2.3万吨,同比增加

2024-03-21