2025年人工智能与进攻性安全研究报告

摘要: 人工智能(AI)正在深刻重塑网络安全格局,尤其是在进攻性安全领域。云安全联盟大中华区(CSA GCR)发布的《20250514-CSA GCR:AI应用于进攻性安全》报告指出,以大语言模型(LLM)和AI智能体为代表的AI技术,正从辅 ...

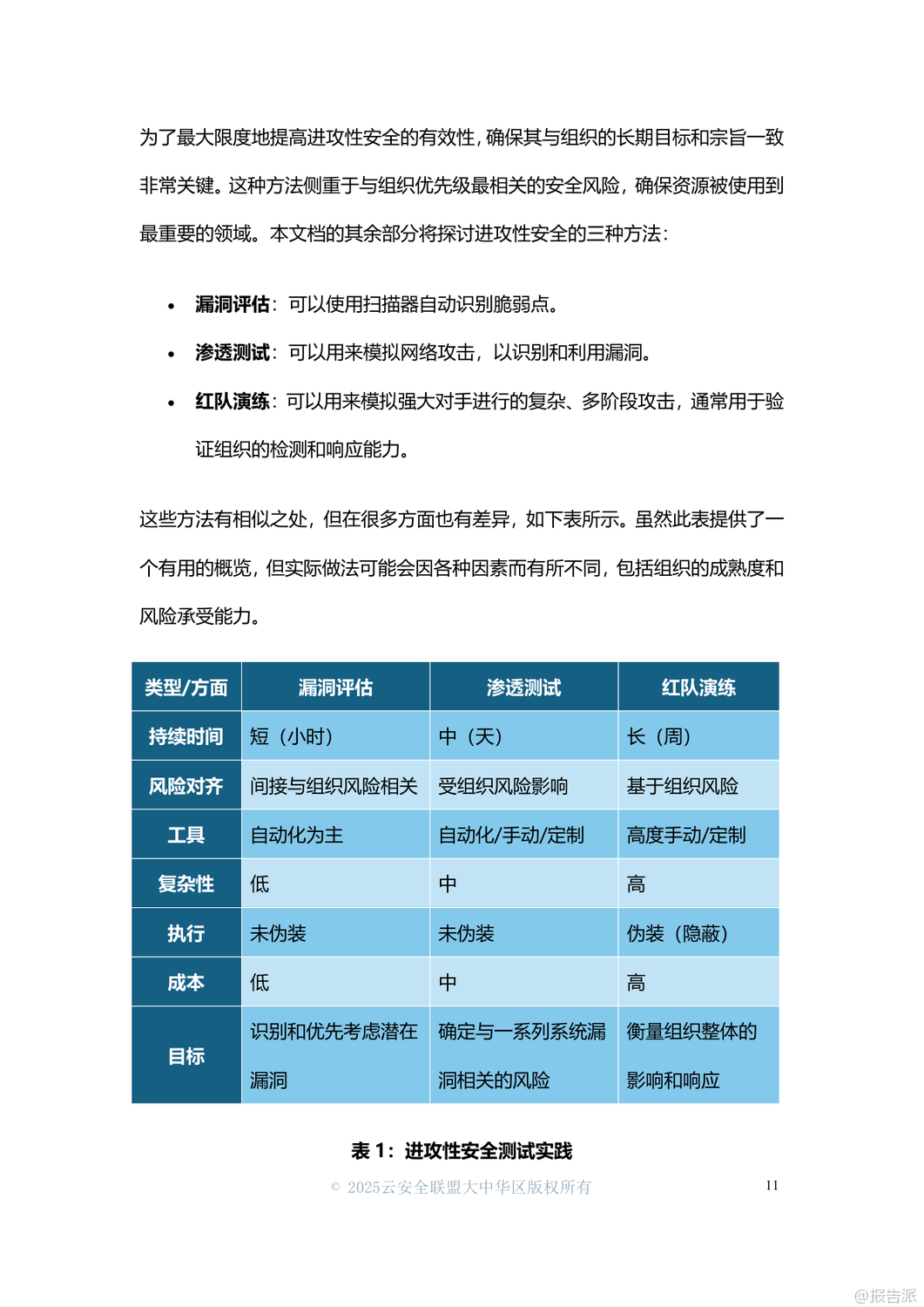

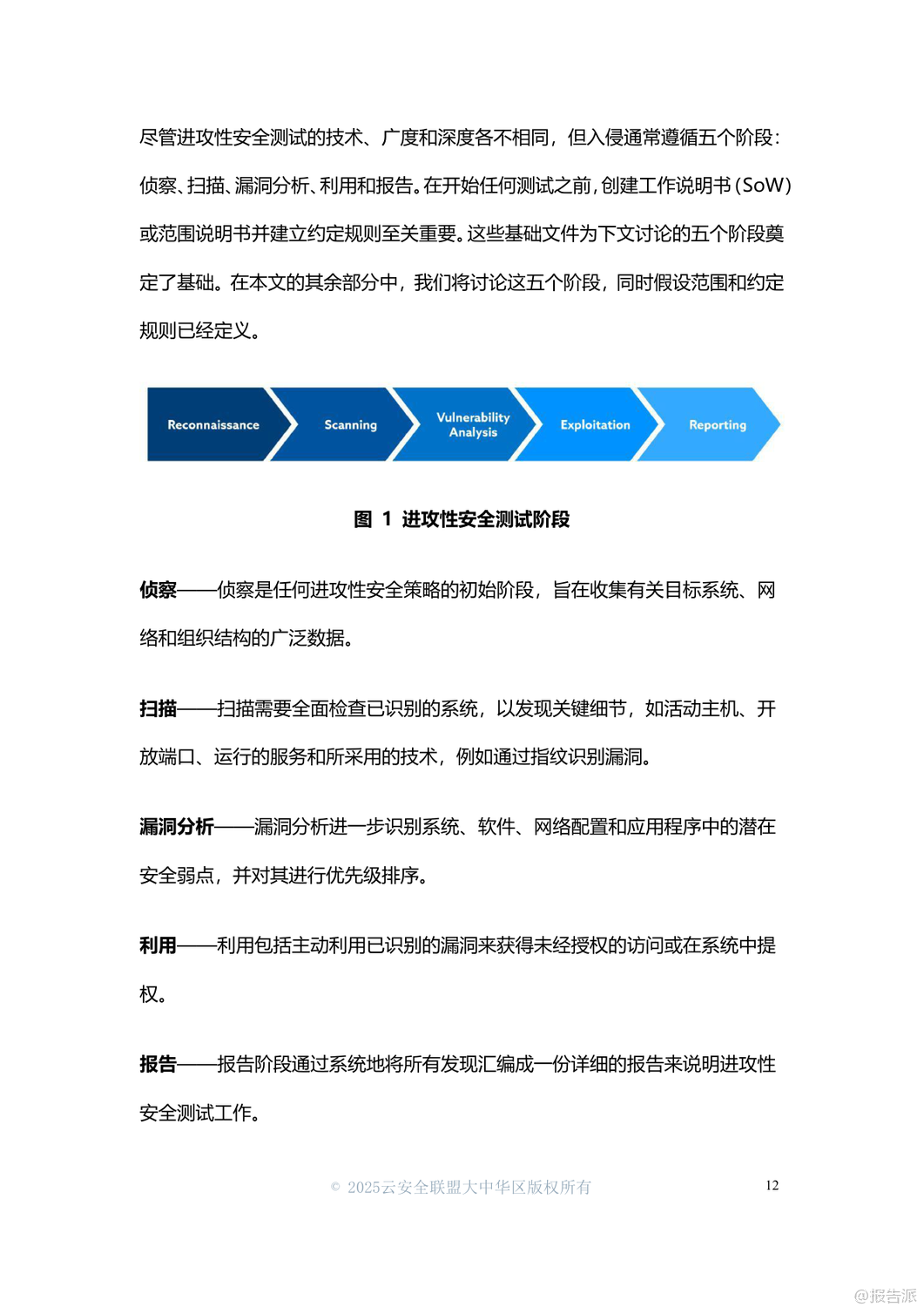

| 人工智能(AI)正在深刻重塑网络安全格局,尤其是在进攻性安全领域。 云安全联盟大中华区(CSA GCR)发布的《20250514-CSA GCR:AI应用于进攻性安全》报告指出,以大语言模型(LLM)和AI智能体为代表的AI技术,正从辅助工具演变为推动漏洞评估、渗透测试和红队演练革新的核心驱动力。 这份49页的深度报告系统剖析了AI在进攻性安全五大阶段——侦察、扫描、漏洞分析、利用与报告中的应用潜力、现实挑战与未来趋势。 报告开篇强调,当前进攻性安全面临严峻挑战:攻击面因云计算、物联网等新技术而急剧扩张,高级威胁手段层出不穷,专业人才严重短缺,且自动化与手动测试的平衡难以把握。 AI的出现为此提供了破局思路。 LLM凭借其强大的数据处理、代码生成、逻辑推理和工具编排能力,能够自动化耗时任务,如大规模开源情报(OSINT)搜集、扫描结果分析和报告撰写,从而让安全专家从重复劳动中解放,聚焦于更具战略性的深度分析和创新攻击路径探索。 在具体应用层面,AI展现出惊人潜力。 在侦察阶段,AI可自动分析网络流量、日志和公开数据,精准绘制攻击面。 进入扫描环节,AI能优化扫描器配置并智能解读海量输出,快速定位关键漏洞。 漏洞分析中,AI通过情境感知分析,关联威胁情报与业务影响,有效降低误报、发现隐藏风险,并在代码审计中表现优于传统SAST工具。 利用阶段是AI能力的集中体现,从规划最优攻击路径、生成社会工程学话术,到自动开发概念验证(PoC)甚至利用“一日漏洞”和“零日漏洞”,已有研究证明AI智能体能达到87%的成功率。 最后,AI可自动生成图文并茂的报告,实现发现到修复建议的闭环。 然而,报告冷静地指出“没有银弹”。 AI的局限性不容忽视,包括“幻觉”导致的事实性错误、Token长度限制、对领域知识的依赖以及潜在的数据泄露风险。 更关键的是,恶意攻击者同样在利用AI增强其能力,使得攻防双方的较量升级为AI技术的对抗。 因此,报告强调,未来方向是“人机协同”,即保持“人在回路”的监督,将AI的效率与人类的判断力相结合。 同时,必须建立完善的治理、风险与合规(GRC)框架,确保AI的使用安全、可靠、符合伦理,防止滥用和失控。 总而言之,AI不是取代安全专家,而是成为其不可或缺的“超级外脑”,推动进攻性安全向更智能、更高效、更普及的方向演进。 出品方:CSA GCR 发布时间:2025年 文档页数:49页

|

上一篇:2025年数据库行业技术趋势报告下一篇:2025年文科生AI编程研究报告

推荐文章

2

2025年云计算行业应用场景报告

资讯

140人已阅读

3

2025年文科生AI编程研究报告

资讯

152人已阅读

4

2025年人工智能与进攻性安全研究报告

资讯

141人已阅读

5

2025年数据库行业技术趋势报告

资讯

134人已阅读

6

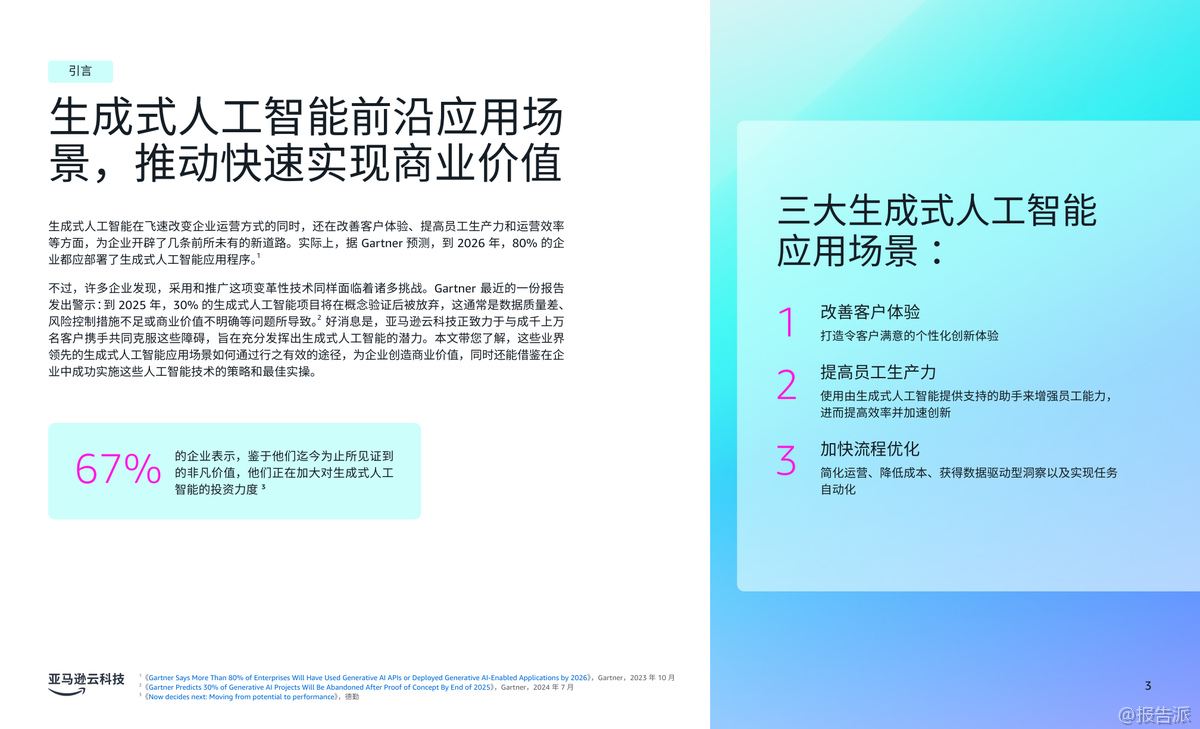

2025年生成式人工智能商业价值报告

资讯

137人已阅读

7

2025年体育领域政策汇编报告

资讯

131人已阅读

8

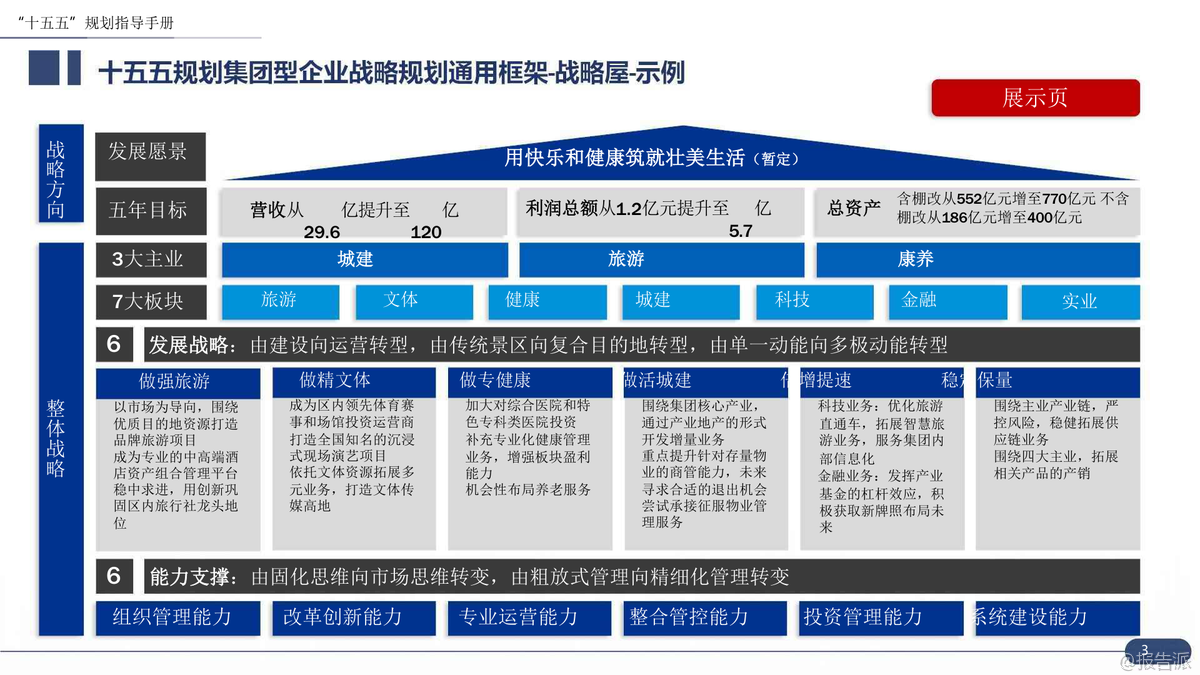

2025年大型央国企“十五五”战略规划编制实

资讯

171人已阅读

9

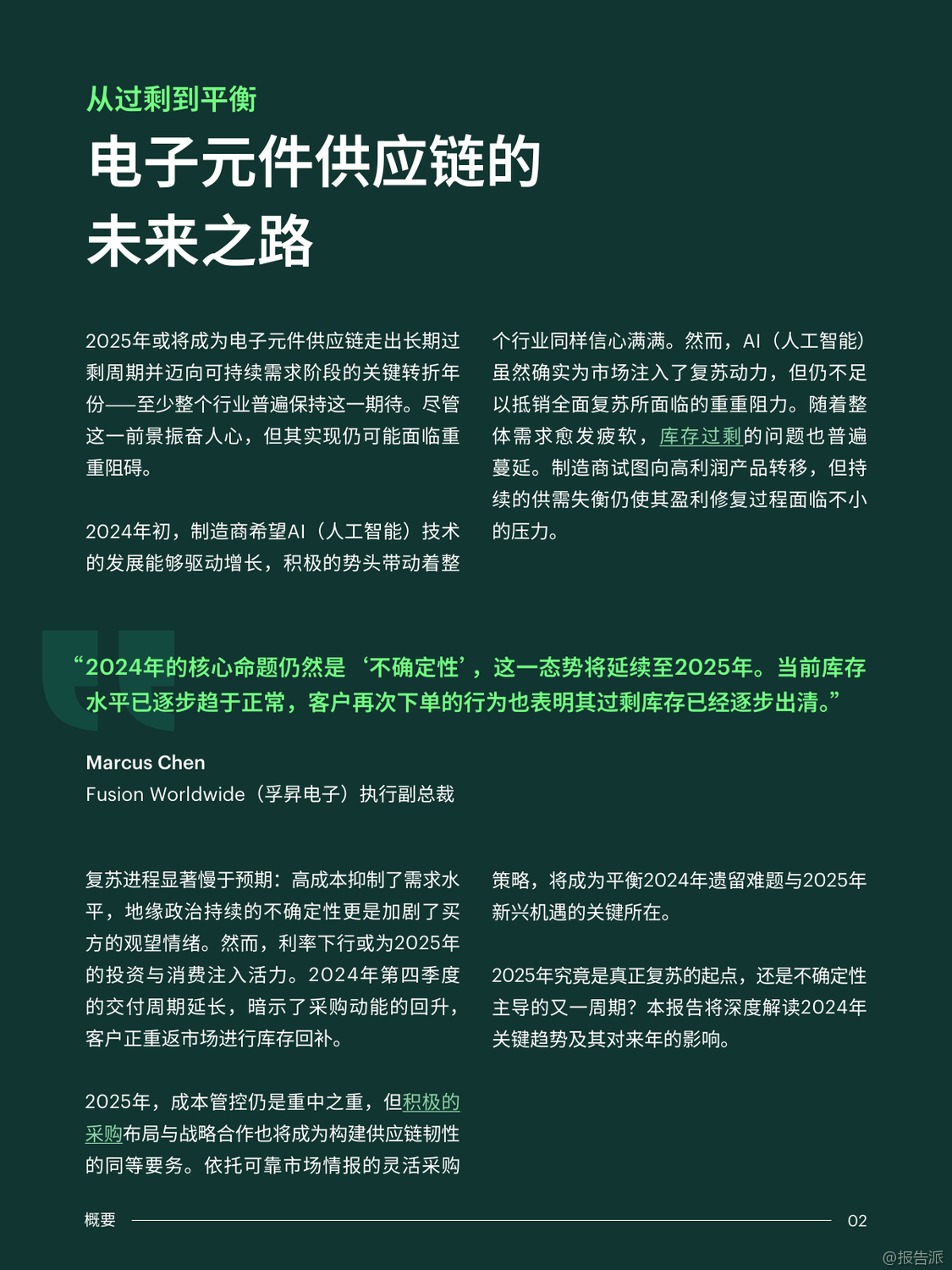

2025年电子元件供应链研究报告

资讯

142人已阅读

10

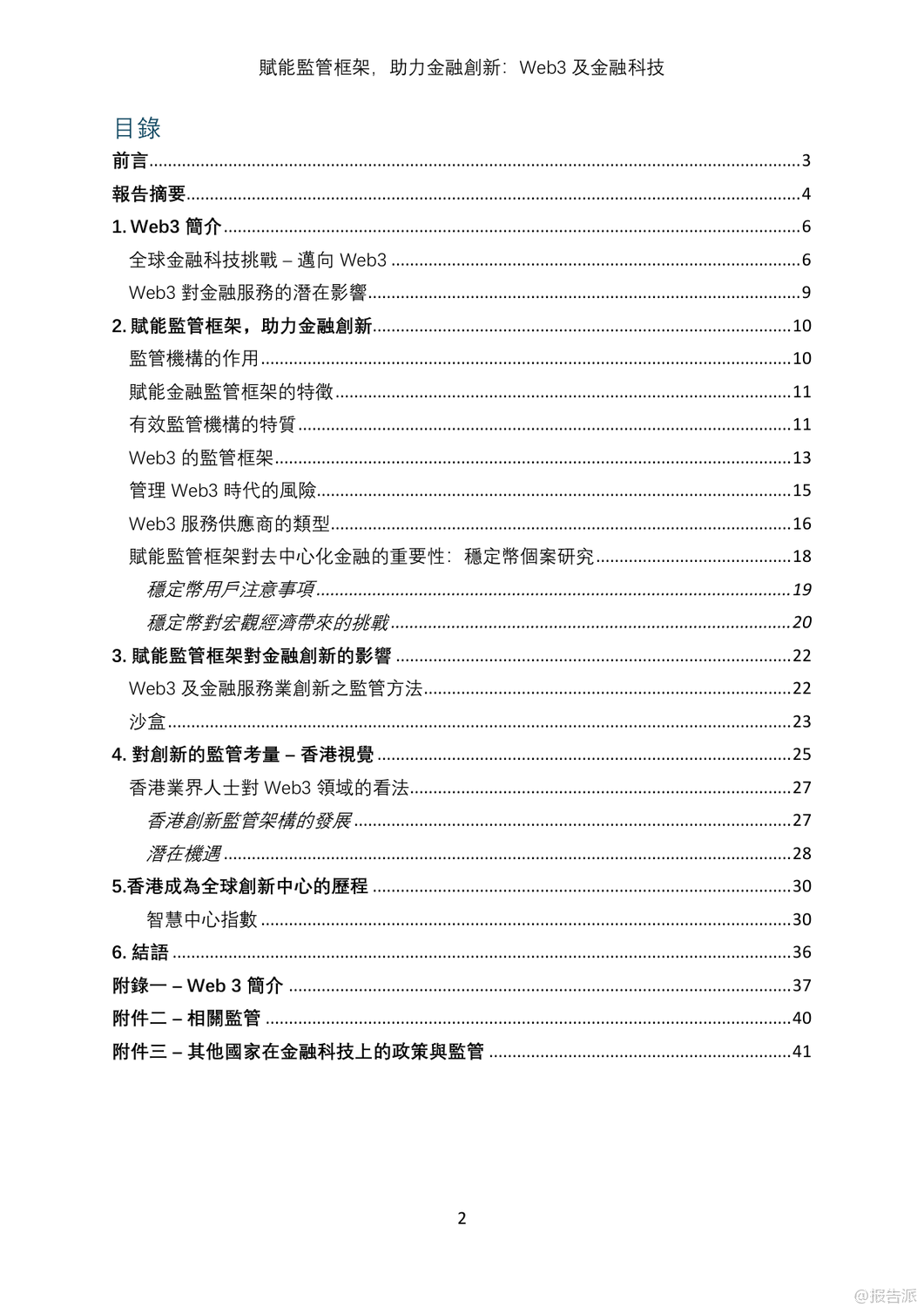

2024年Web3及金融科技研究报告

资讯

110人已阅读

数据图表

2

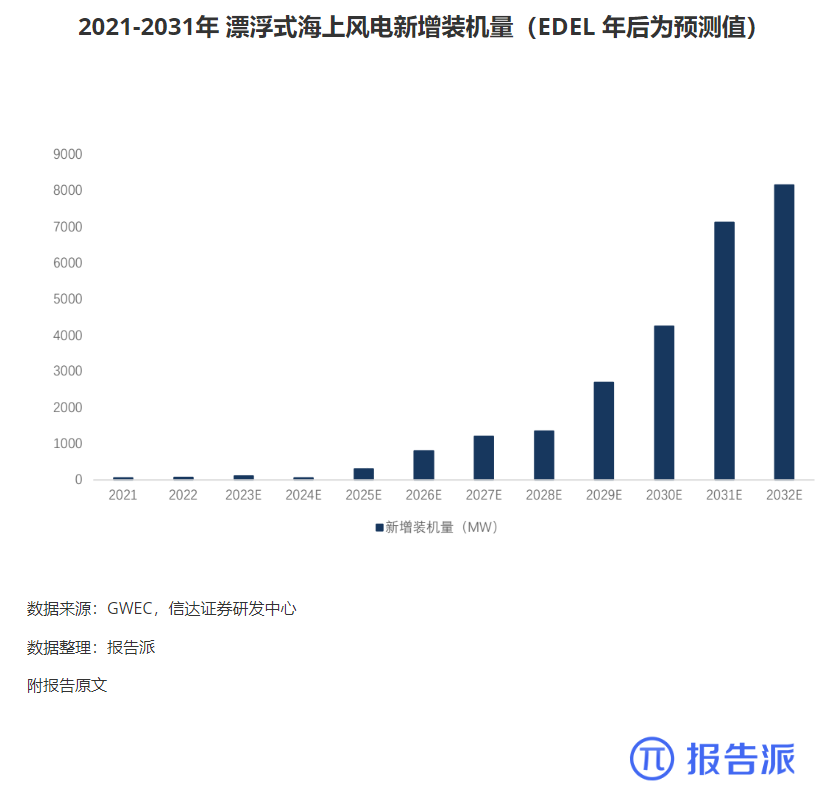

2011-2031 年全球海上风电装机量(含预测)

行业数据

1748人已阅读

3

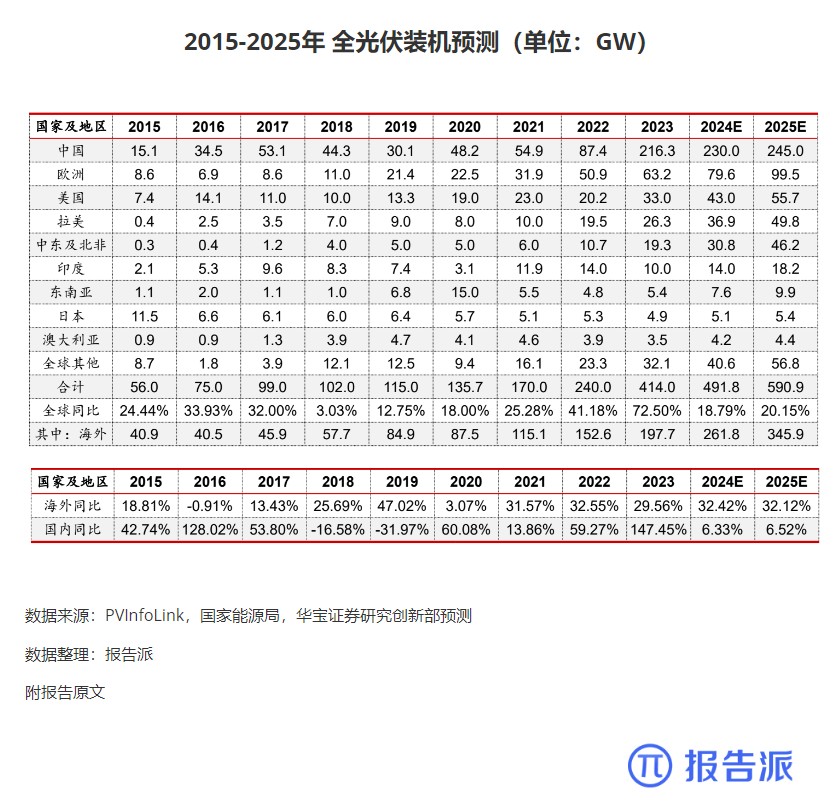

2015-2025年 全光伏装机预测(单位:GW)

市场规模

1978人已阅读

4

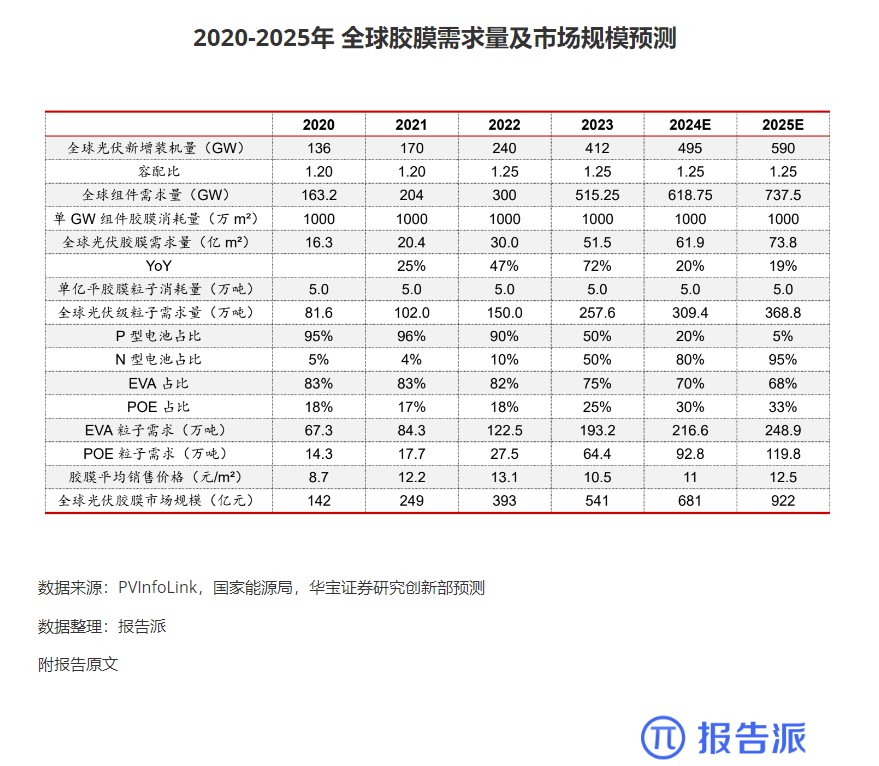

2020-2025年 全球胶膜需求量及市场规模预测

市场规模

1893人已阅读

5

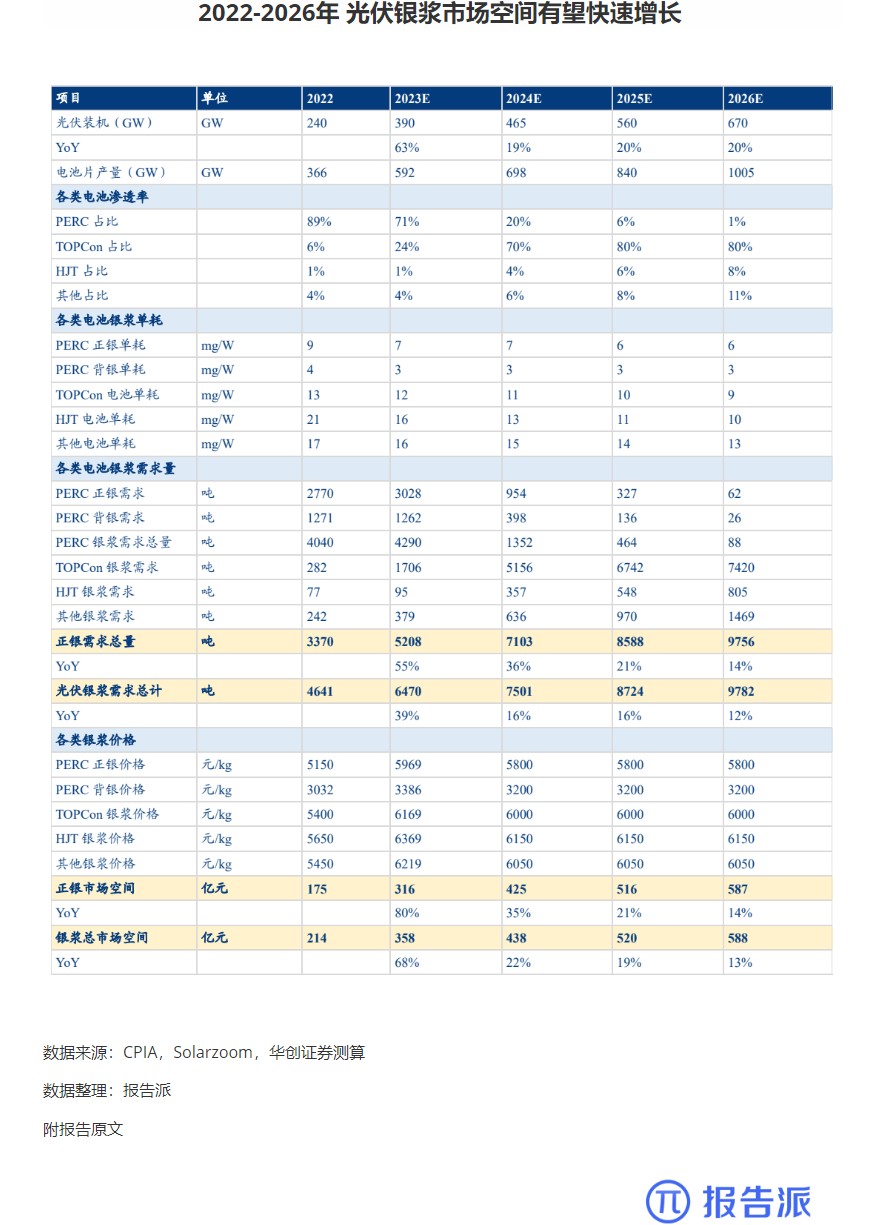

2022-2026年 光伏银浆市场空间有望快速增长

市场规模

1954人已阅读

6

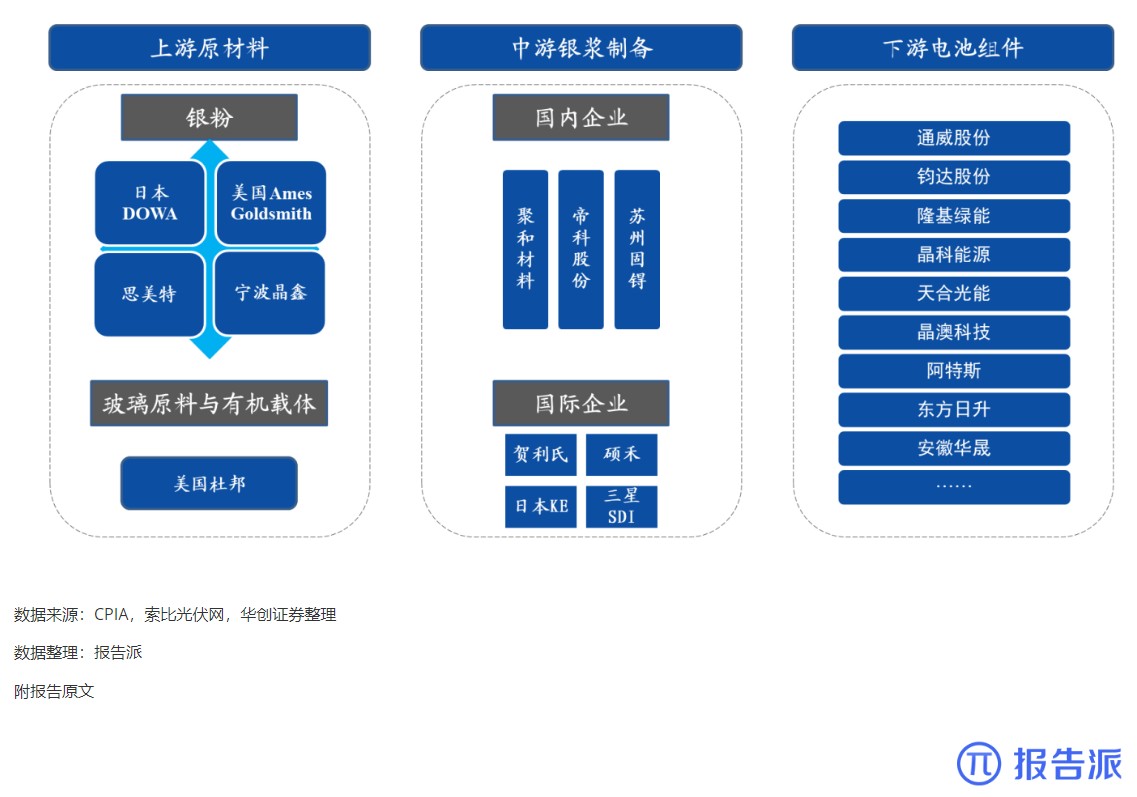

光伏银浆产业链相对简单

技术工艺

1856人已阅读

7

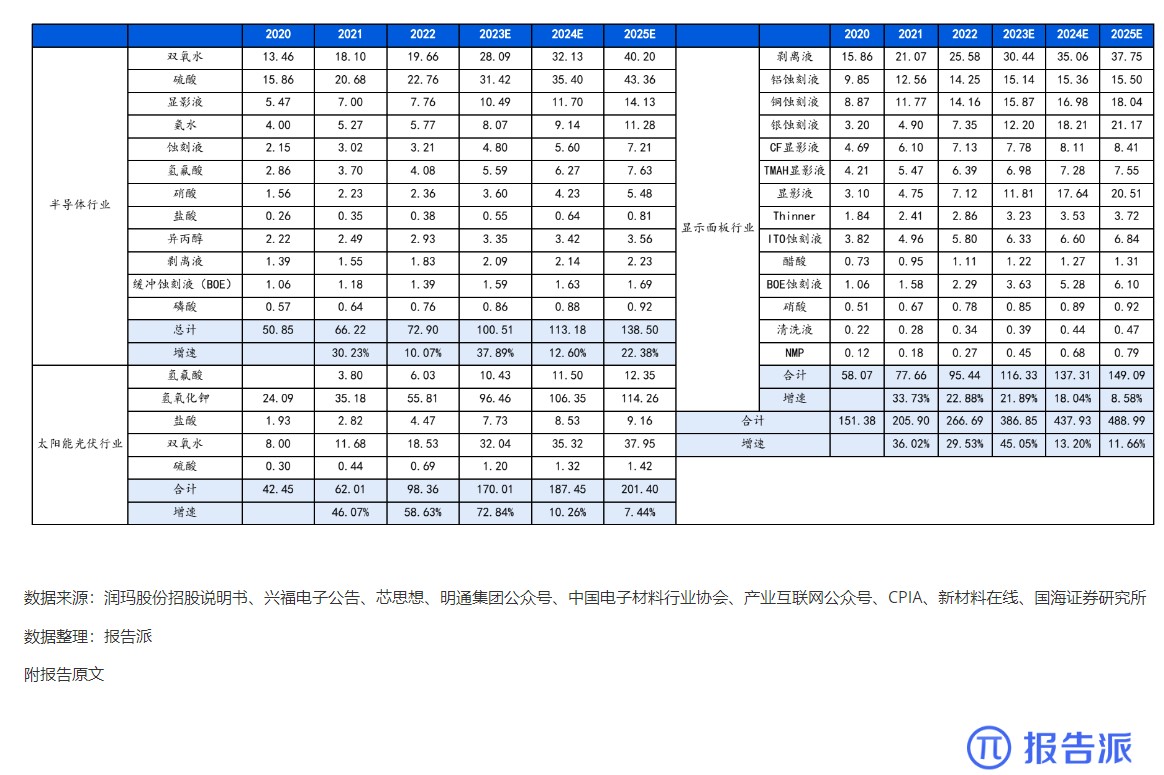

2020-2025年 我国湿电子化学品需求预测(万

市场规模

1826人已阅读

8

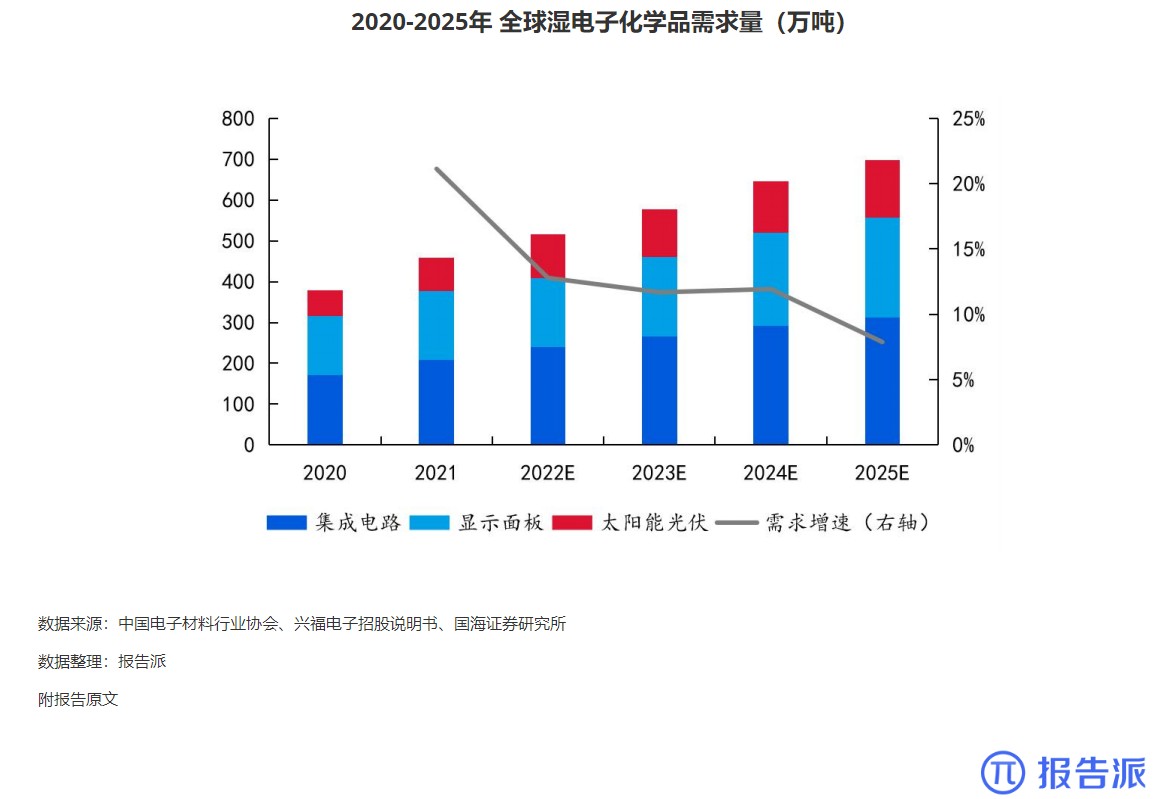

2020-2025年 全球湿电子化学品需求量(万吨

市场规模

1962人已阅读

9

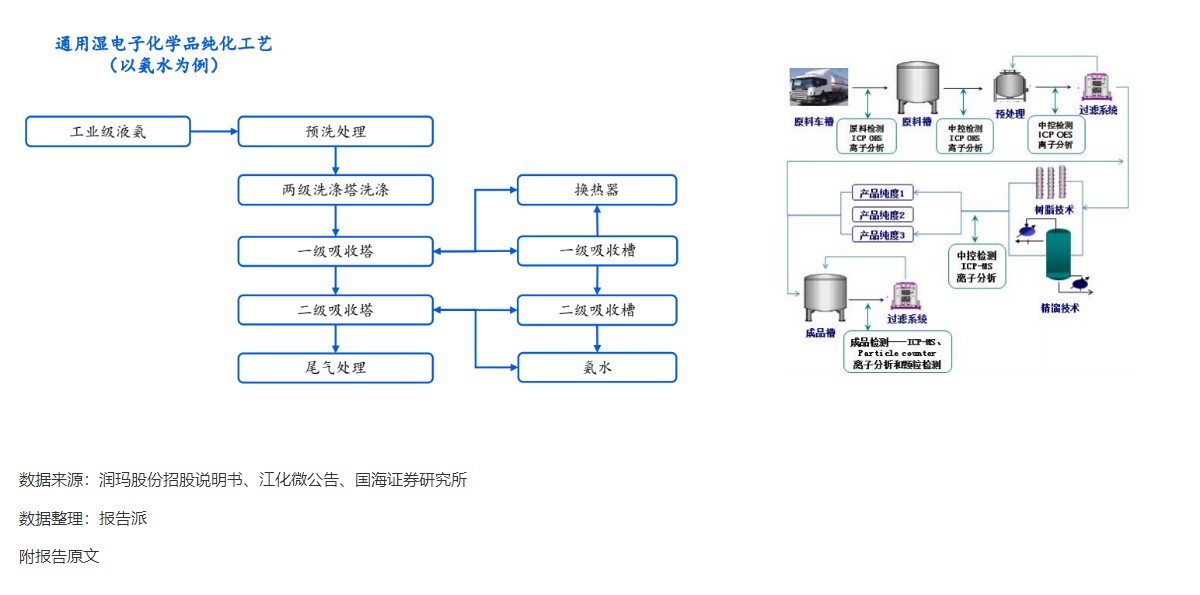

通用湿电子化学品纯化工艺

技术工艺

1702人已阅读

10

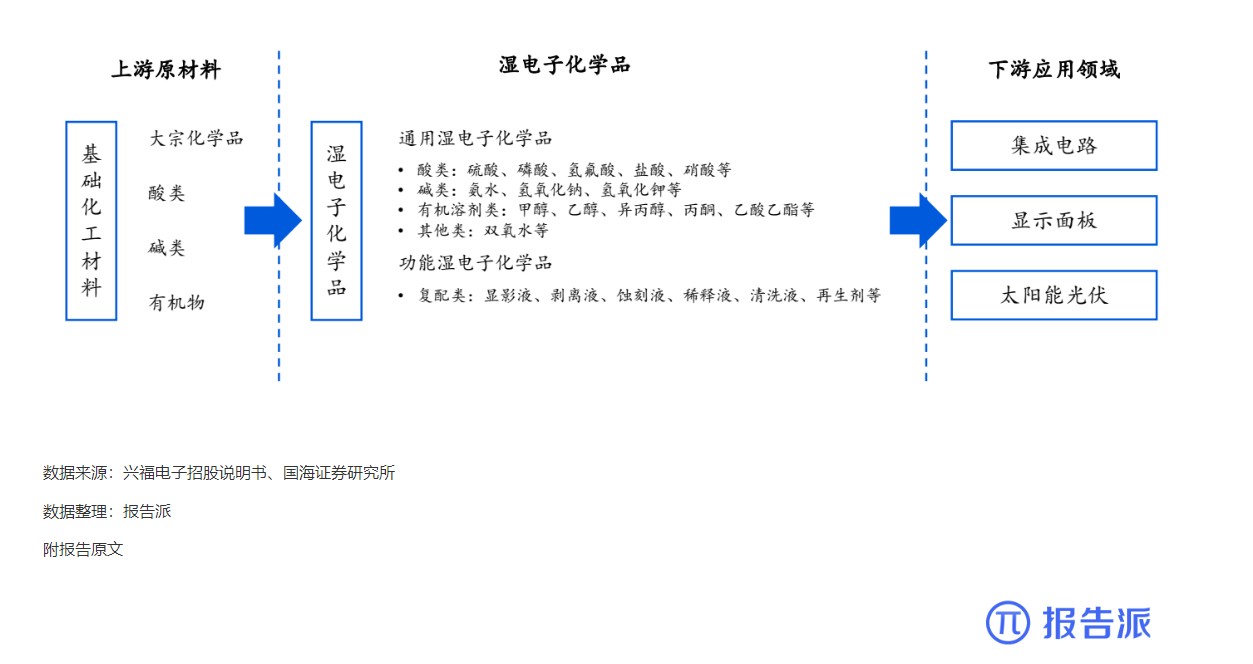

湿电子化学品上下游产业链基本情况

技术工艺

1978人已阅读

热门数据

1

2024年1—2月份规模以上工业增加值增长7.0%

2024-03-22

2

截至2023年底我国累计建成充电基础设施859.

2024-03-22

3

2024年3月21日人民币 NDF 远期合约汇兑美元

2024-03-21

4

2024年1—2月份能源生产情况

2024-03-21

5

2024年2月银行结售汇和银行代客涉外收付款

2024-03-21

6

2024年3月韩国方便面出口2.3万吨,同比增加

2024-03-21