2025年智能IP广域网与AI训推技术研究报告

摘要: 在人工智能加速发展的当下,企业对大模型训练与推理的算力需求呈爆发式增长。然而,如何在保障数据安全的同时降低算力成本,成为政企用户面临的核心难题。由中国信息通信研究院与华为联合发布的《基于智能IP广域网( ...

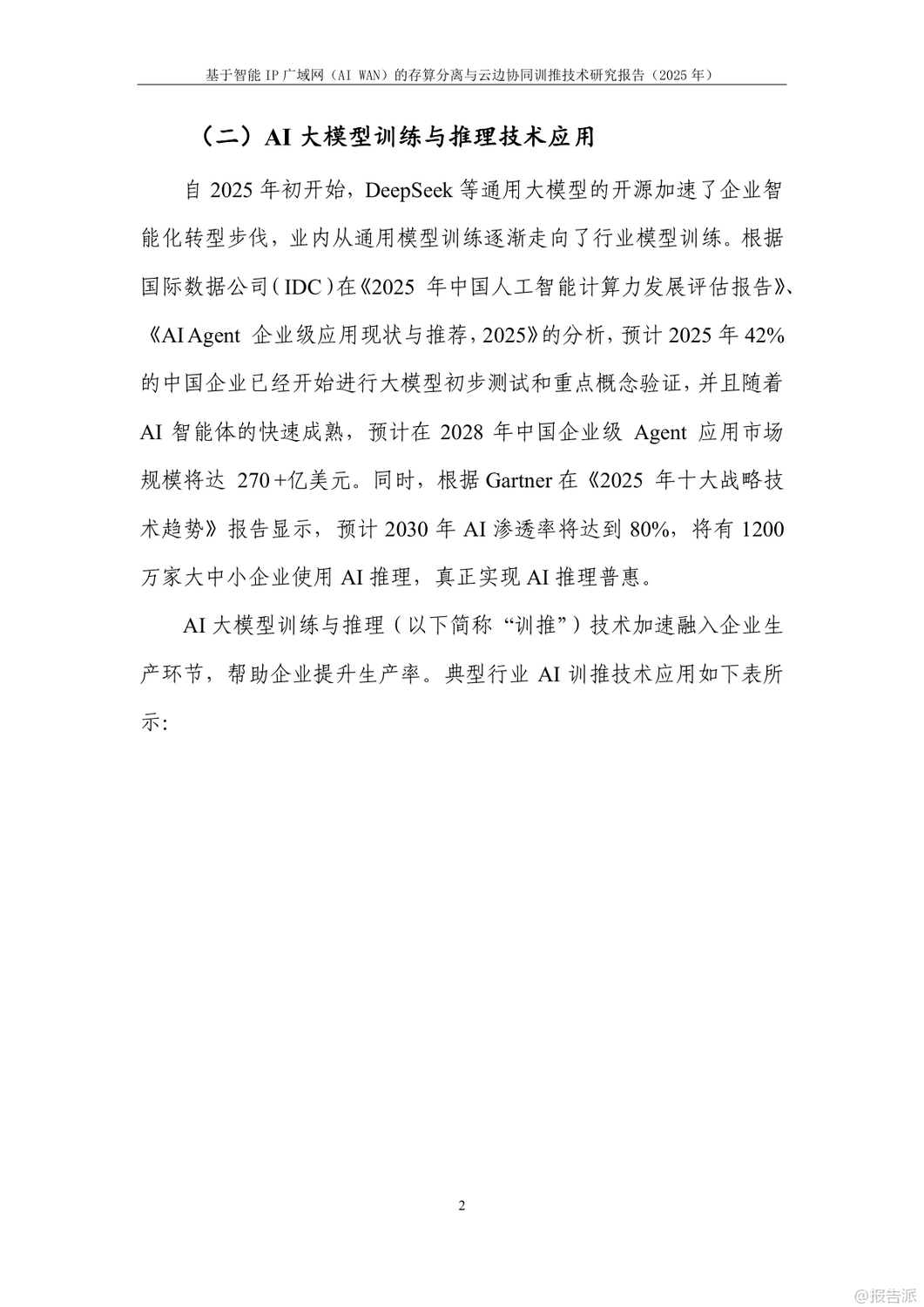

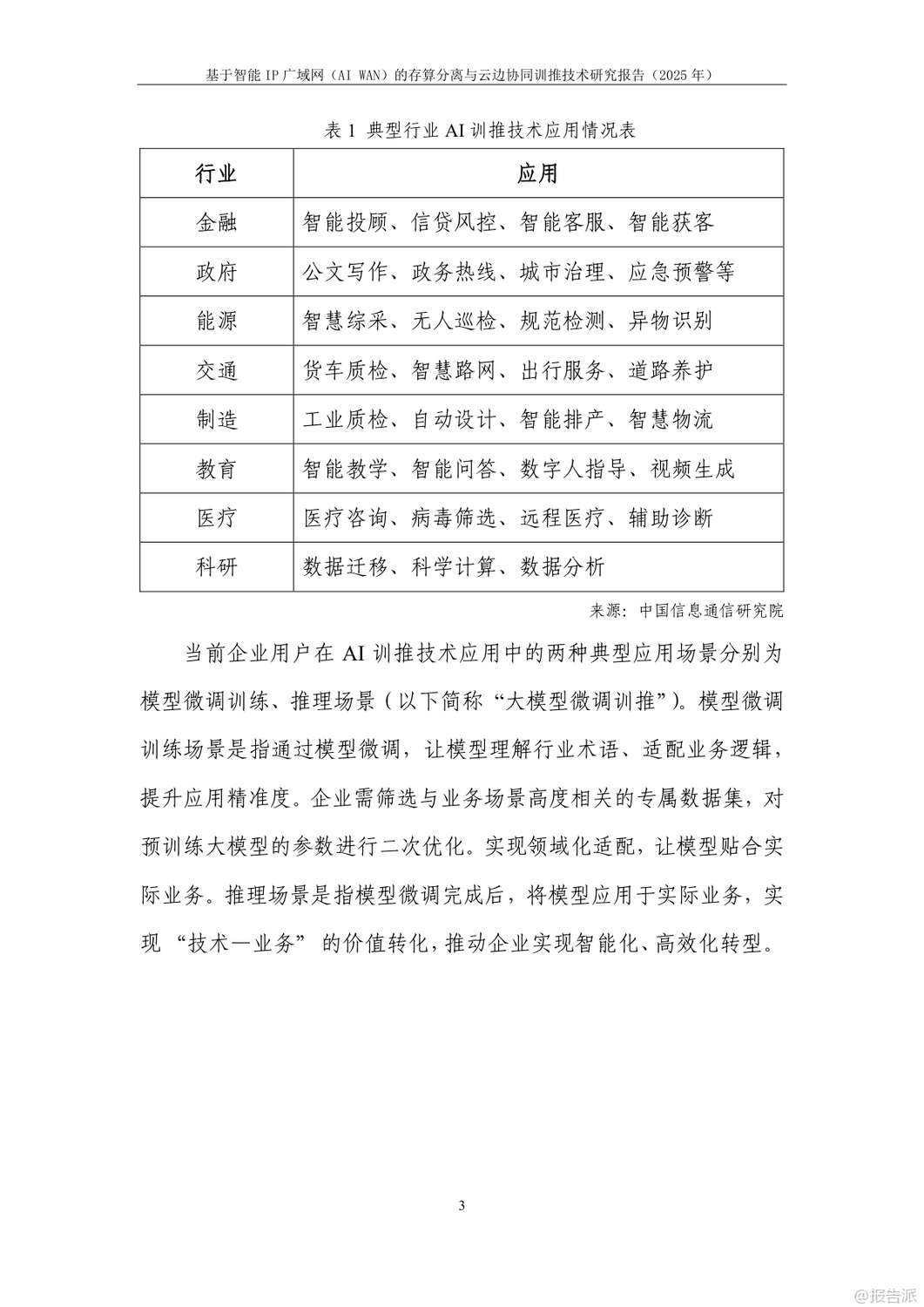

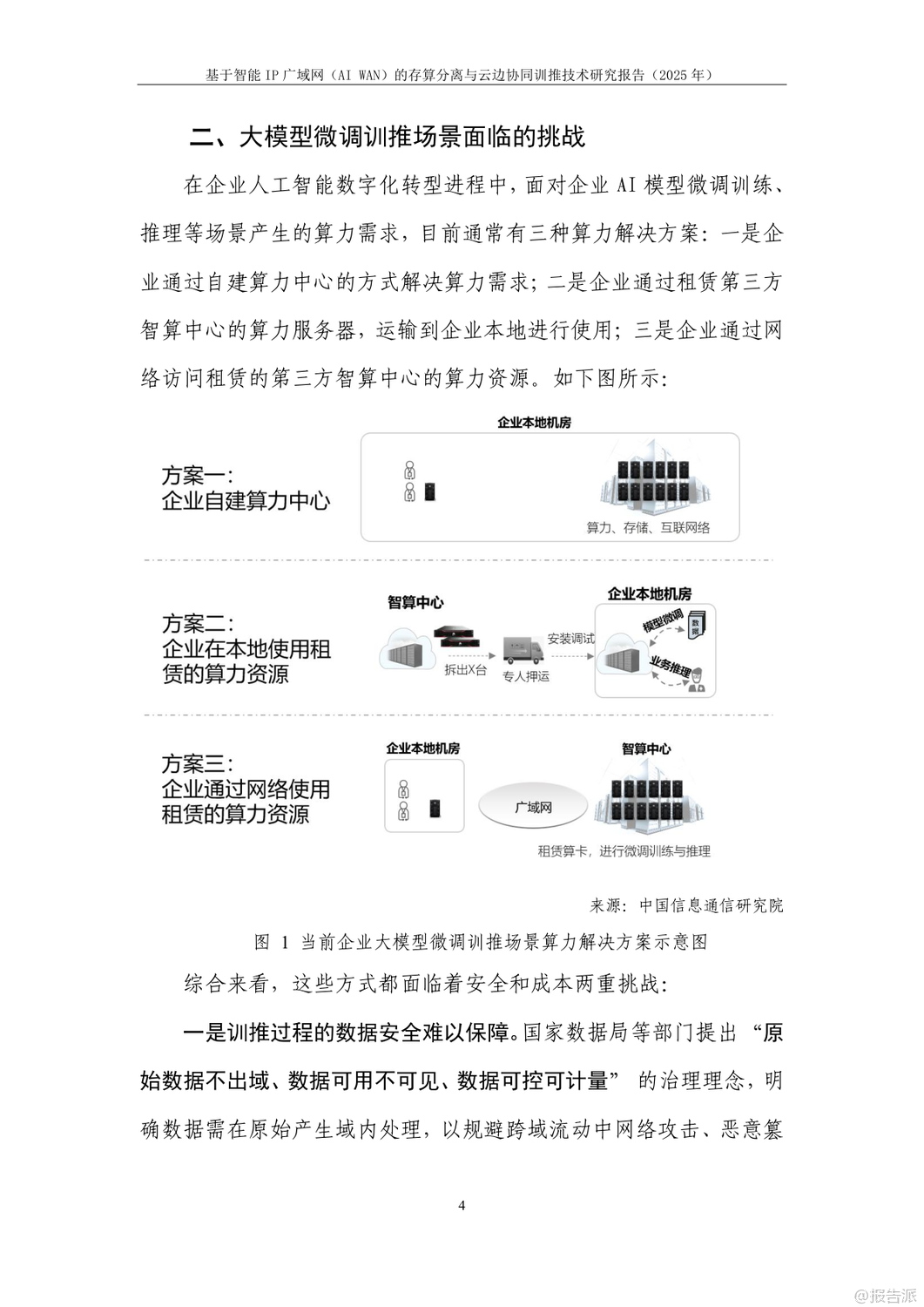

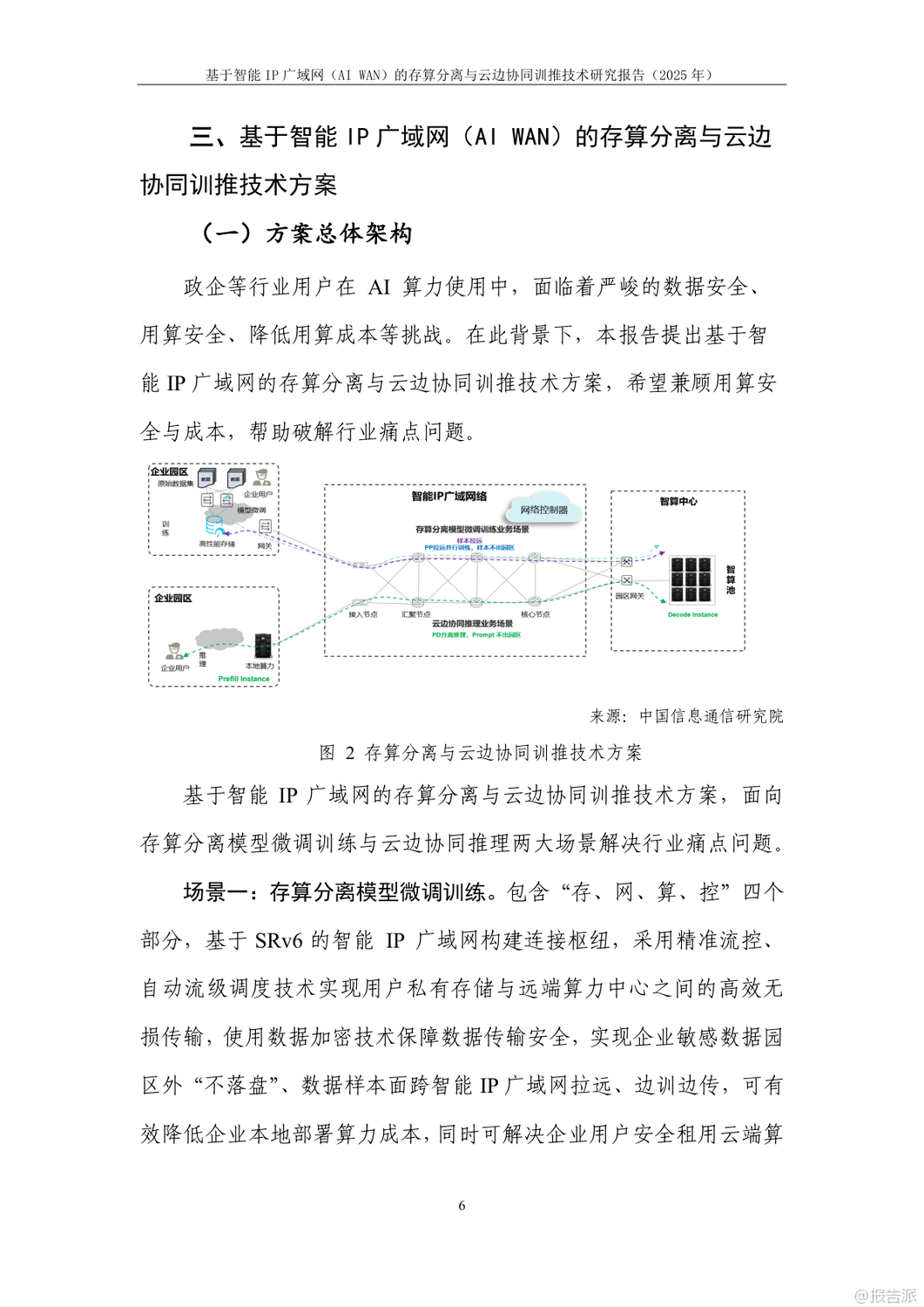

| 在人工智能加速发展的当下,企业对大模型训练与推理的算力需求呈爆发式增长。 然而,如何在保障数据安全的同时降低算力成本,成为政企用户面临的核心难题。 由中国信息通信研究院与华为联合发布的《基于智能IP广域网(AI WAN)的存算分离与云边协同训推技术研究报告(2025年)》正是针对这一矛盾提出系统性解决方案。 报告指出,当前企业AI训推主要依赖自建算力、租赁算力服务器搬至本地、或通过网络远程租用云端算力三种模式。 但这些方式普遍存在数据泄露风险高、投资成本大、网络传输效率低等问题。 尤其是在金融、政务、医疗等敏感行业,“原始数据不出域”已成为硬性合规要求。 为此,报告创新性地提出“存算分离+云边协同”的双轨技术路径。 在模型微调训练场景中,采用“存算分离”模式:企业本地保留数据存储,仅将训练过程中的中间结果通过智能IP广域网传输至远端算力中心进行计算。 结合精准流控与自动流级调度技术,即使在100公里乃至400公里的拉远距离下,仍可实现97%以上的高算效,真正做到“数据不落盘、不出域”。 而在推理场景中,则采用“云边协同”架构。 通过模型拆分学习技术,将大模型的首尾层部署在企业侧,中间计算密集层部署在云端。 网络中仅传输无法还原原始数据的高维向量,从根本上杜绝了数据泄露风险。 实验证明,在200公里拉远场景下,Qwen-32B模型推理算效劣化不超过5%,边侧算力利用率仅为4%,大幅降低了企业本地部署成本。 支撑这两大场景的核心技术包括三项:一是模型拆分学习,实现数据与模型的物理隔离;二是精准流控技术,基于SRv6与租户级反压机制,避免拥塞扩散,保障多租户业务稳定;三是自动流级调度技术,通过控制器实时感知大象流并动态调优路径,提升整网带宽利用率,降低企业用网成本。 实验室验证结果显示,在LLAMA2、Qwen、ResNet、DeepSeek等主流大模型上,该方案均能实现接近本地训练的算效表现,同时网络抓包证实云边协同模式下传输内容完全加密,安全性远超传统方案。 展望未来,该技术有望在医疗、金融、能源等高安全要求行业率先落地。 随着标准体系的建立和试点推广,智能IP广域网将成为连接企业数据与云端算力的安全高速通道,推动AI真正实现“可用、可信、可负担”的普惠化发展。 出品方:信通院 发布时间:2025年 文档页数:24页

|

推荐文章

2

2025年云计算行业应用场景报告

资讯

77人已阅读

3

2025年文科生AI编程研究报告

资讯

79人已阅读

4

2025年人工智能与进攻性安全研究报告

资讯

82人已阅读

5

2025年数据库行业技术趋势报告

资讯

78人已阅读

6

2025年生成式人工智能商业价值报告

资讯

75人已阅读

7

2025年体育领域政策汇编报告

资讯

75人已阅读

8

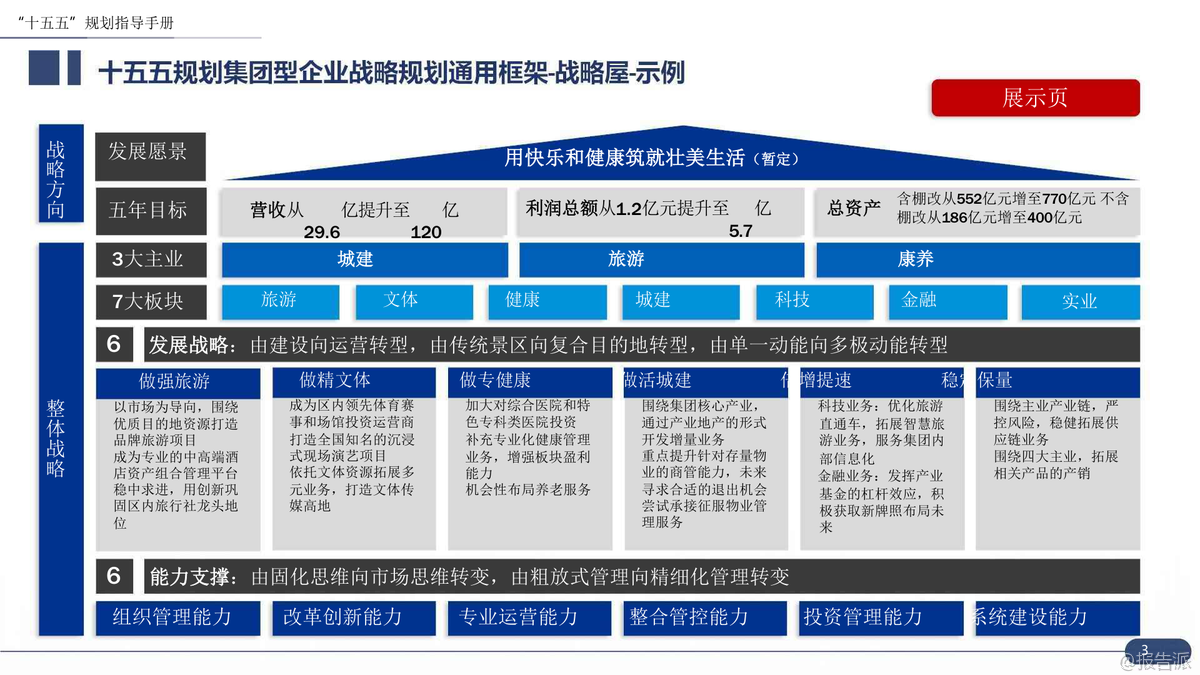

2025年大型央国企“十五五”战略规划编制实

资讯

97人已阅读

9

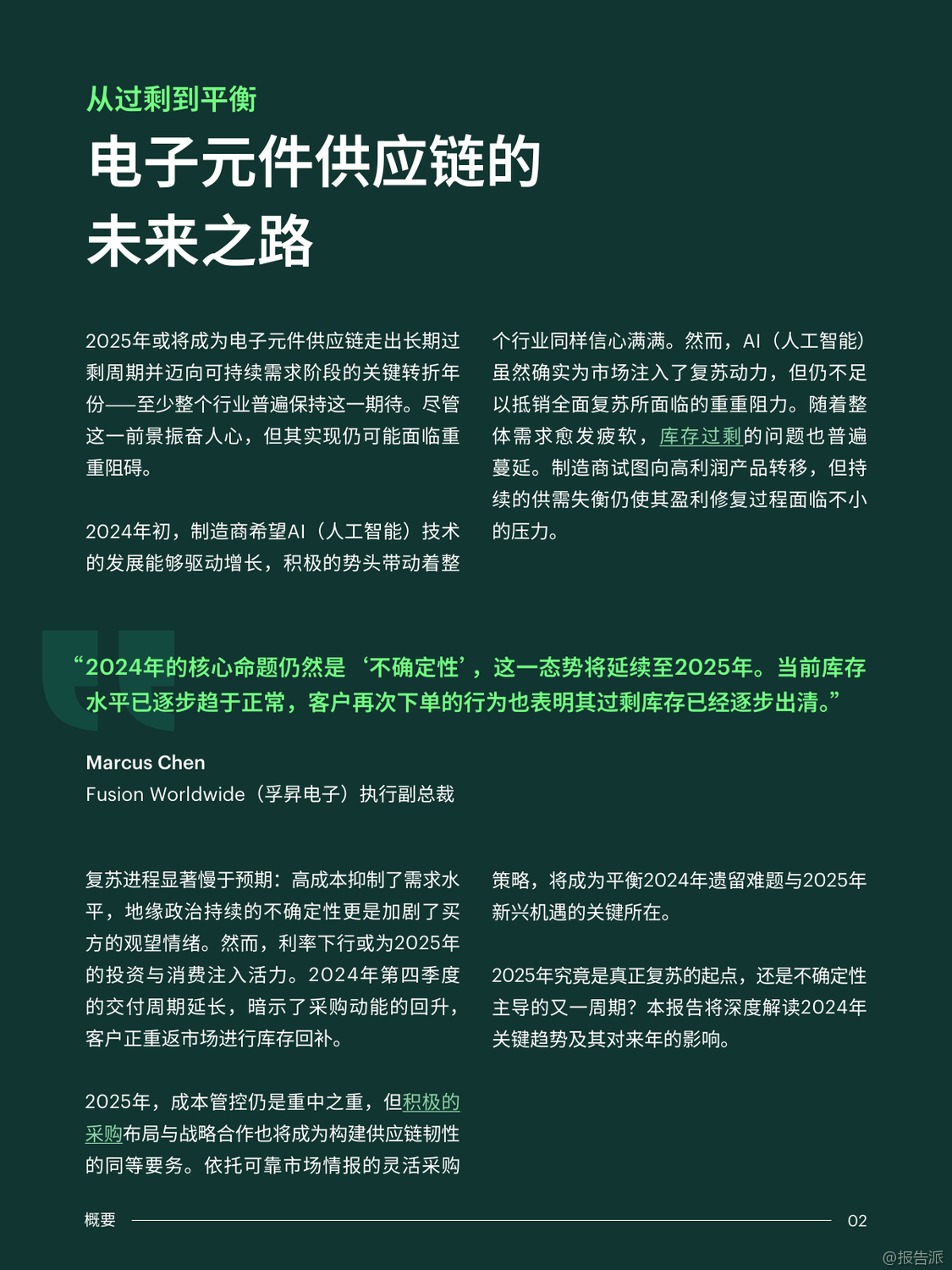

2025年电子元件供应链研究报告

资讯

93人已阅读

10

2024年Web3及金融科技研究报告

资讯

69人已阅读

数据图表

2

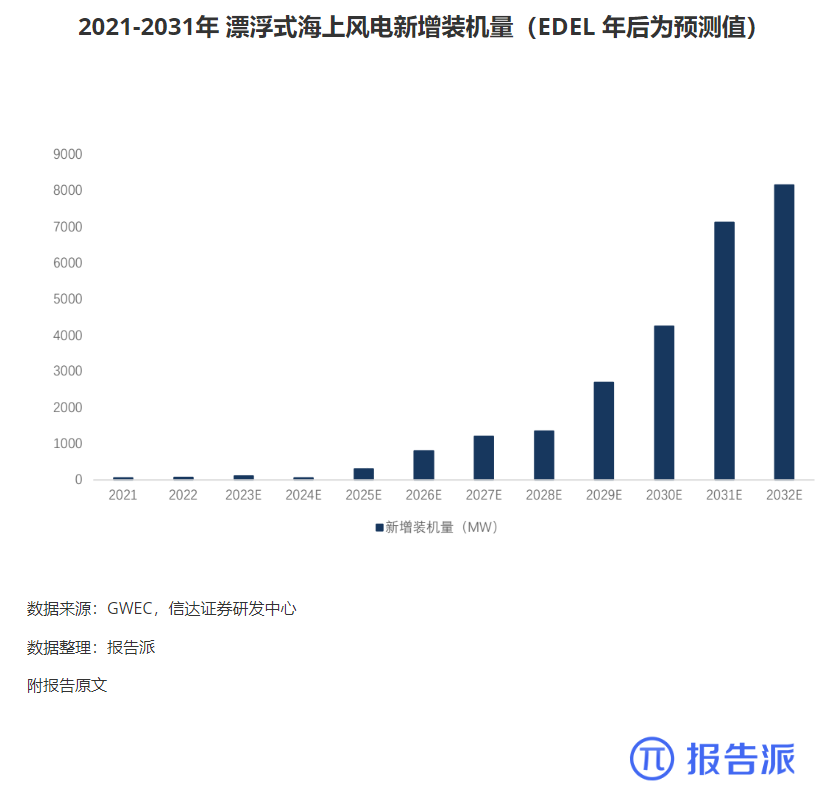

2011-2031 年全球海上风电装机量(含预测)

行业数据

1716人已阅读

3

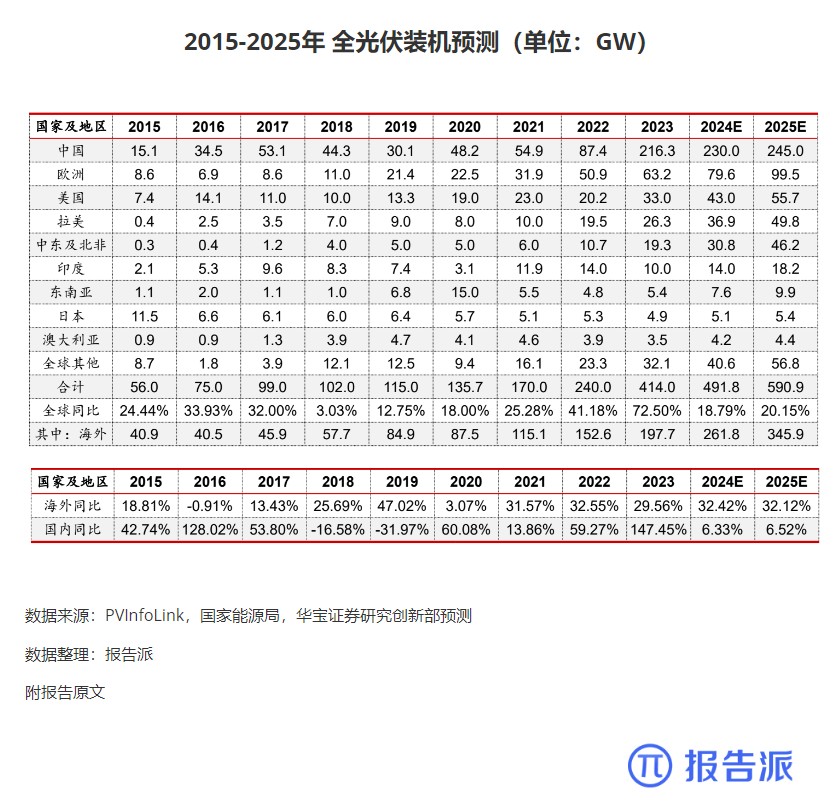

2015-2025年 全光伏装机预测(单位:GW)

市场规模

1949人已阅读

4

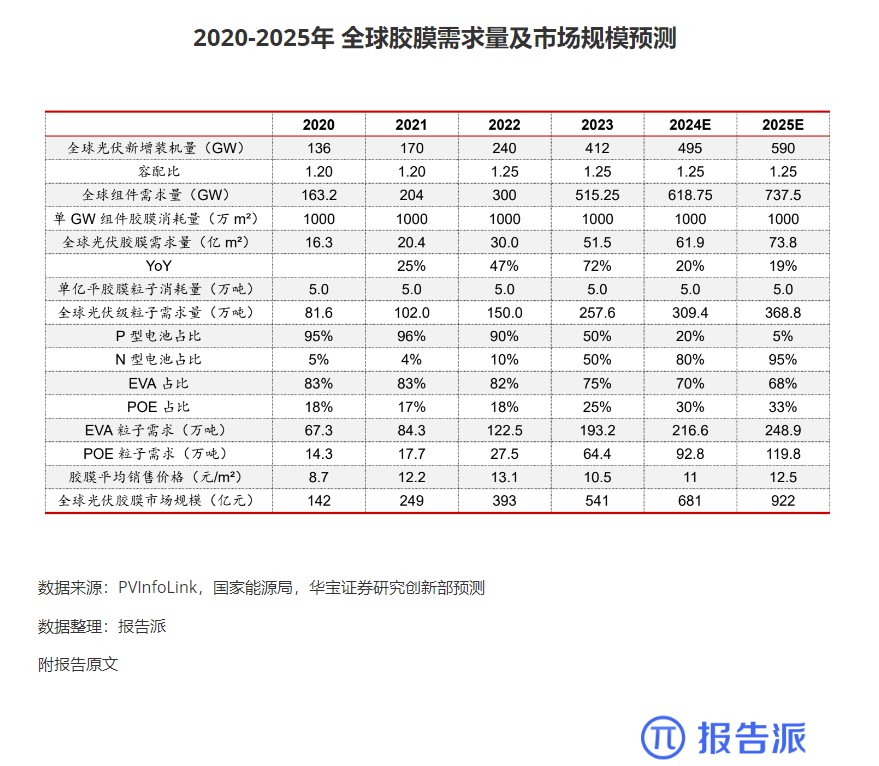

2020-2025年 全球胶膜需求量及市场规模预测

市场规模

1862人已阅读

5

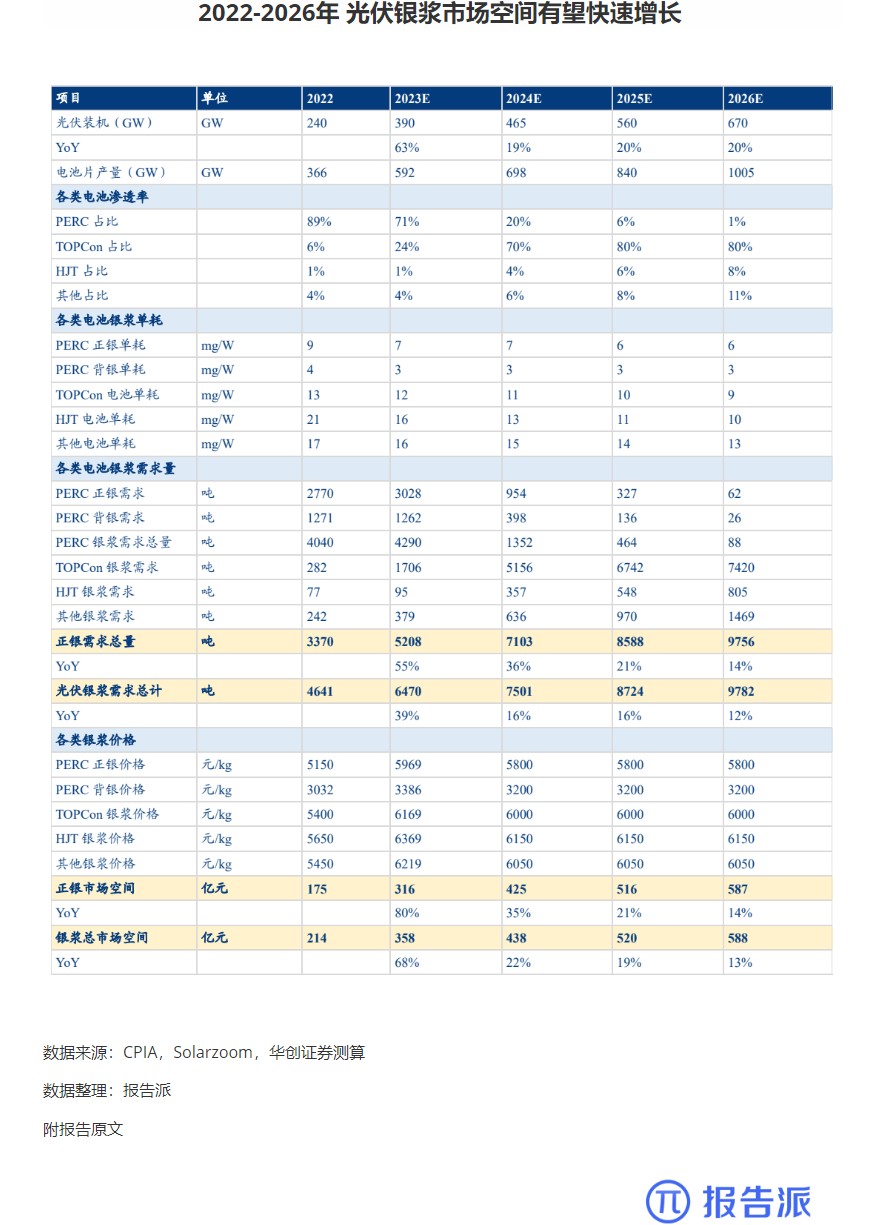

2022-2026年 光伏银浆市场空间有望快速增长

市场规模

1932人已阅读

6

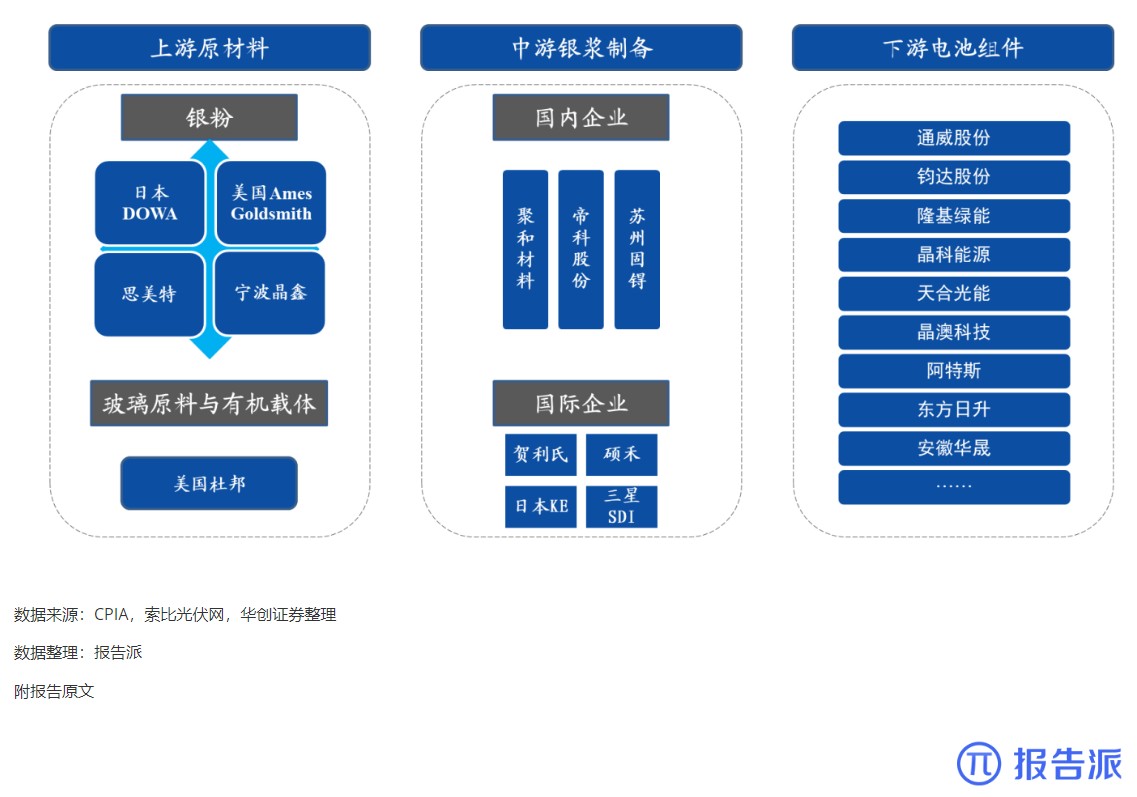

光伏银浆产业链相对简单

技术工艺

1828人已阅读

7

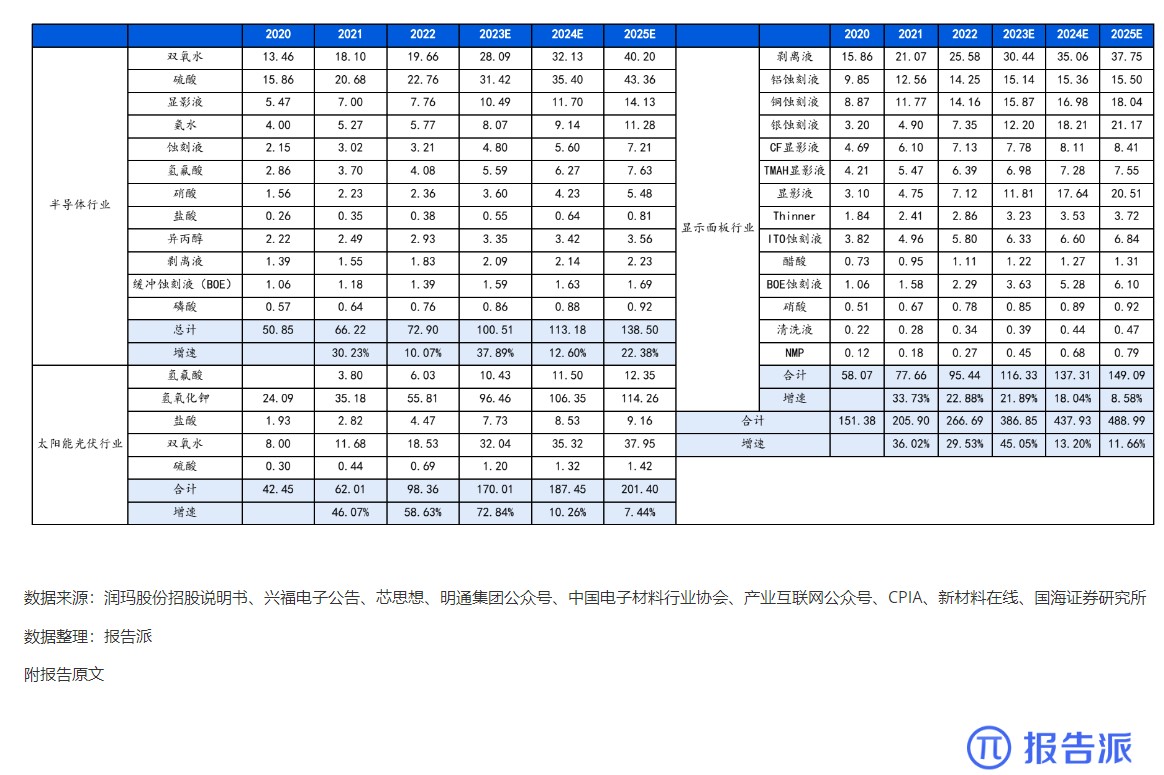

2020-2025年 我国湿电子化学品需求预测(万

市场规模

1813人已阅读

8

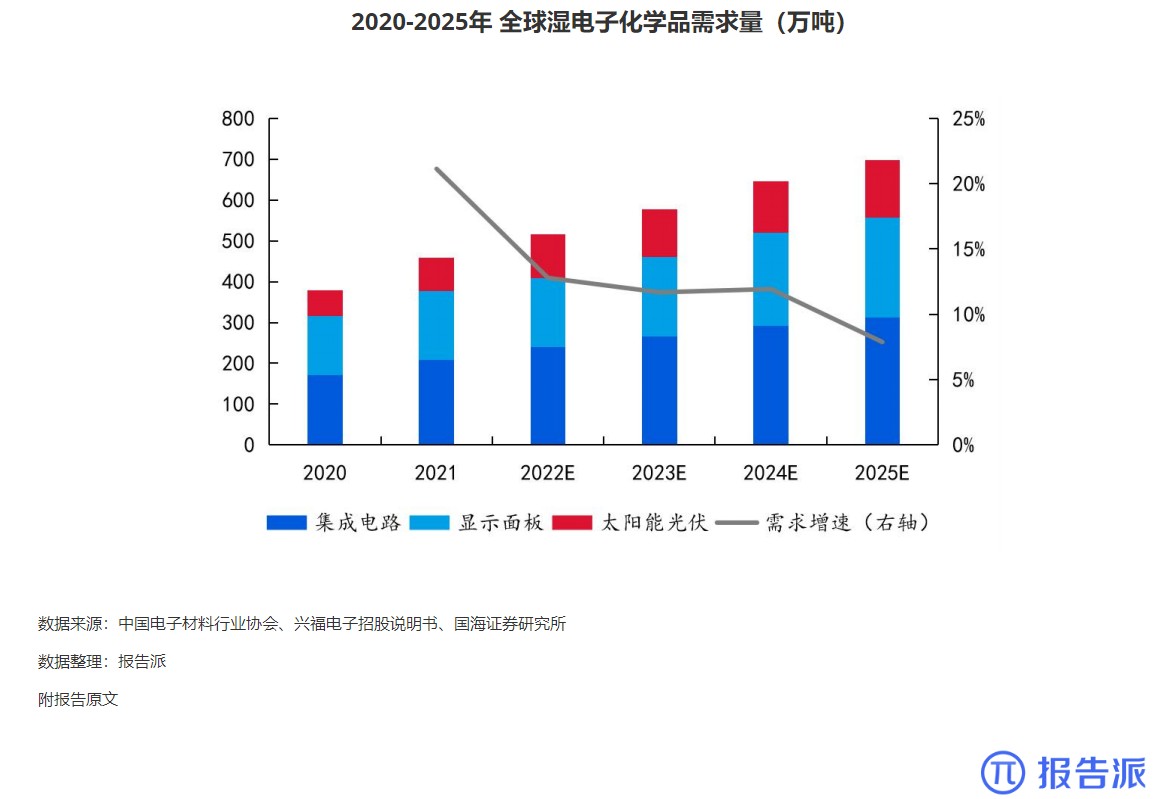

2020-2025年 全球湿电子化学品需求量(万吨

市场规模

1935人已阅读

9

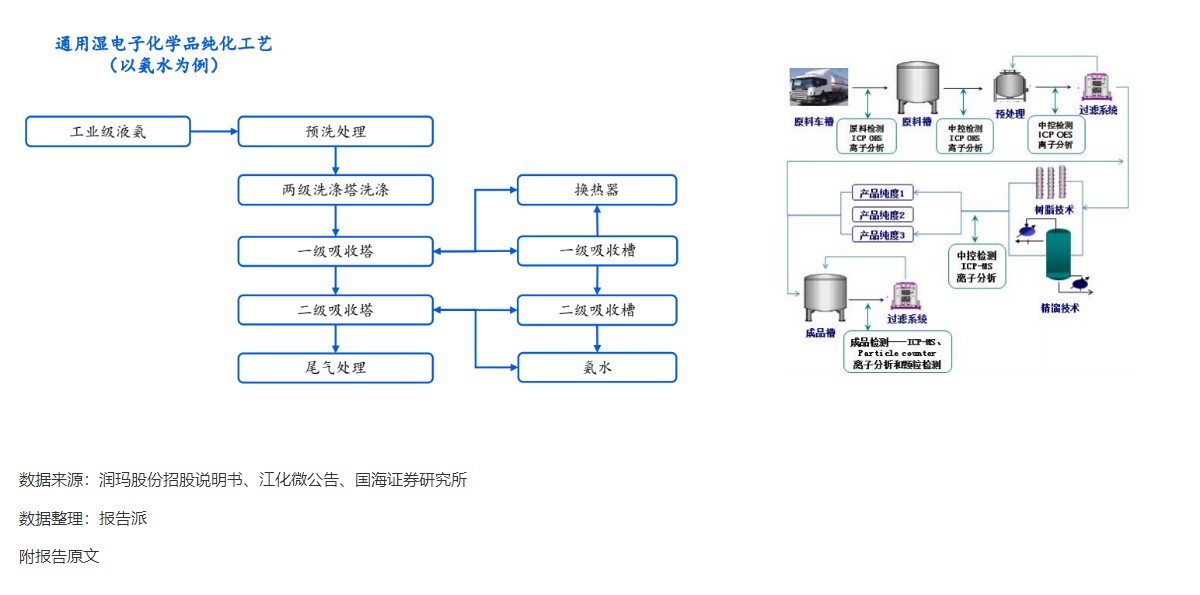

通用湿电子化学品纯化工艺

技术工艺

1674人已阅读

10

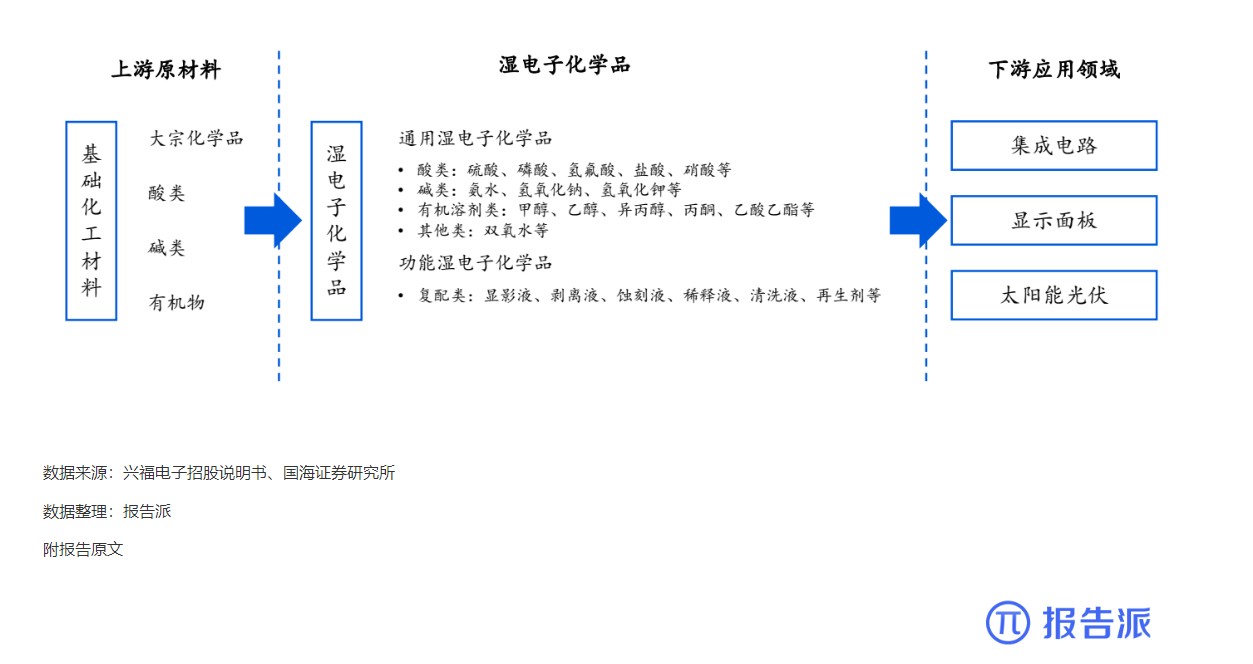

湿电子化学品上下游产业链基本情况

技术工艺

1944人已阅读

热门数据

1

2024年1—2月份规模以上工业增加值增长7.0%

2024-03-22

2

截至2023年底我国累计建成充电基础设施859.

2024-03-22

3

2024年3月21日人民币 NDF 远期合约汇兑美元

2024-03-21

4

2024年1—2月份能源生产情况

2024-03-21

5

2024年2月银行结售汇和银行代客涉外收付款

2024-03-21

6

2024年3月韩国方便面出口2.3万吨,同比增加

2024-03-21